Автоэнкодер

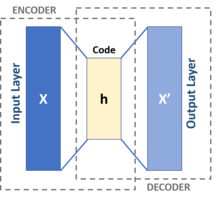

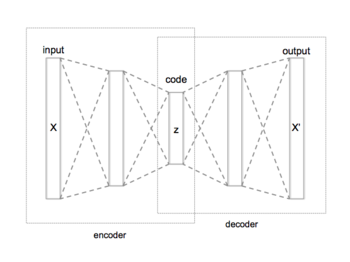

Автоэнкодер — это тип искусственной нейронной сети , используемый для обучения эффективному кодированию неразмеченных данных ( обучение без учителя ). [1] [2] Автоэнкодер изучает две функции: функцию кодирования, которая преобразует входные данные, и функцию декодирования, которая воссоздает входные данные из закодированного представления. Автоэнкодер изучает эффективное представление (кодирование) набора данных, как правило, для уменьшения размерности .

Существуют варианты, направленные на то, чтобы выученные представления приобрели полезные свойства. [3] Примерами являются регуляризованные автоэнкодеры ( Sparse , Denoising и Contractive ), которые эффективны при изучении представлений для последующих задач классификации , [4] и вариационные автоэнкодеры с приложениями в качестве генеративных моделей . [5] Автоэнкодеры применяются для решения многих задач, включая распознавание лиц , [6] обнаружение признаков, [7] обнаружение аномалий и определение значения слов. [8] [9]Автоэнкодеры также являются генеративными моделями, которые могут случайным образом генерировать новые данные, похожие на входные данные (данные для обучения). [7]

Два набора: пространство декодированных сообщений ; пространство закодированных сообщений . Почти всегда оба и являются евклидовыми пространствами, т. е. для некоторых .

Два параметризованных семейства функций: семейство энкодера , параметризуемое ; семейство декодеров , параметризованное .

Для любого мы обычно пишем и называем его кодом, скрытой переменной , скрытым представлением, скрытым вектором и т. д. И наоборот, для любого мы обычно пишем и называем его (декодированным) сообщением.