В статистике , то коэффициент корреляции Пирсона ( PCC , выраженный / р ɪər с ən / ), также упоминаются как Пирсон г , на коэффициент продукта момента корреляции Пирсона ( PPMCC ), или корреляции двумерный , [1] является мерой линейная корреляция между двумя наборами данных. Это ковариация двух переменных, деленная на произведение их стандартных отклонений.; таким образом, это, по сути, нормализованное измерение ковариации, так что результат всегда имеет значение от -1 до 1. Как и сама ковариация, мера может отражать только линейную корреляцию переменных и игнорировать многие другие типы взаимосвязей или корреляции. . В качестве простого примера можно ожидать, что возраст и рост выборки подростков из старшей школы будут иметь коэффициент корреляции Пирсона значительно больше 0, но меньше 1 (поскольку 1 будет представлять нереально идеальную корреляцию).

Именование и история [ править ]

Он был разработан Карлом Пирсоном на основе связанной идеи, предложенной Фрэнсисом Гальтоном в 1880-х годах, математическая формула для которой была выведена и опубликована Огюстом Браве в 1844 году. [ A ] [5] [6] [7] [8] Таким образом, название коэффициента является примером закона Стиглера .

Определение [ править ]

Коэффициент корреляции Пирсона - это ковариация двух переменных, деленная на произведение их стандартных отклонений . Форма определения включает «момент продукта», то есть среднее значение (первый момент о происхождении) произведения случайных величин, скорректированных на среднее значение; отсюда и модификатор product-moment в названии.

Для населения [ править ]

Коэффициент корреляции Пирсона, когда он применяется к совокупности , обычно обозначается греческой буквой ρ (ро) и может называться коэффициентом корреляции совокупности или коэффициентом корреляции Пирсона совокупности . [9] Для пары случайных величин формула для ρ [10] такова: [11]

| ( Уравнение 1 ) |

куда:

- является ковариация

- это стандартное отклонение от

- стандартное отклонение

Формула для может быть выражена через среднее значение и ожидание. С

- [10]

формулу для также можно записать как

| ( Уравнение 2 ) |

куда:

- и определены, как указано выше

- это среднее из

- это среднее из

- это ожидание .

Формулу для можно выразить через нецентрированные моменты. С

формулу для также можно записать как

Для образца [ править ]

Коэффициент корреляции Пирсона, когда он применяется к выборке , обычно представлен и может называться коэффициентом корреляции выборки или коэффициентом корреляции Пирсона выборки . [9] Мы можем получить формулу , подставив оценки ковариаций и дисперсий, основанные на выборке, в формулу выше. Учитывая парные данные, состоящие из пар, определяется как:

| ( Уравнение 3 ) |

куда:

- размер выборки

- индивидуальные точки выборки, индексированные с помощью i

- (выборочное среднее ); и аналогично для

Перестановка дает нам следующую формулу :

где определены, как указано выше.

Эта формула предлагает удобный однопроходный алгоритм для расчета выборочных корреляций, хотя в зависимости от задействованных чисел он иногда может быть численно нестабильным .

Повторная перестановка дает нам формулу [10] для :

где определены, как указано выше.

Эквивалентное выражение дает формулу для среднего произведения стандартных оценок следующим образом:

куда

- определены, как указано выше, и определены ниже

- это стандартный счет (и аналогично для стандартного балла )

Также доступны альтернативные формулы для . Например. можно использовать следующую формулу для :

куда:

- определены, как указано выше, и:

- ( стандартное отклонение выборки ); и аналогично для

Практические вопросы [ править ]

В условиях сильного шума извлечение коэффициента корреляции между двумя наборами стохастических переменных нетривиально, в частности, когда канонический корреляционный анализ сообщает о ухудшенных значениях корреляции из-за сильного влияния шума. Обобщение подхода дано в другом месте. [12]

В случае отсутствия данных Гаррен получил оценку максимального правдоподобия . [13]

Математические свойства [ править ]

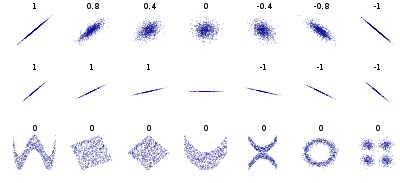

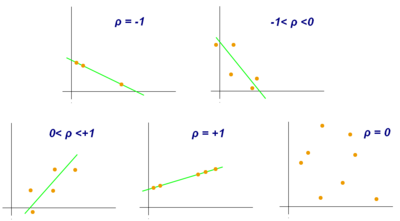

Абсолютные значения коэффициентов корреляции Пирсона выборки и генеральной совокупности находятся в диапазоне от 0 до 1. Корреляции, равные +1 или -1, соответствуют точкам данных, лежащим точно на линии (в случае выборочной корреляции), или двумерное распределение полностью поддерживается на линии (в случае корреляции населения). Коэффициент корреляции Пирсона симметричен: corr ( X , Y ) = corr ( Y , X ).

Ключевым математическим свойством коэффициента корреляции Пирсона является то, что он инвариантен при отдельных изменениях местоположения и масштаба двух переменных. То есть мы можем преобразовать X в a + bX и преобразовать Y в c + dY , где a , b , c и d - константы с b , d > 0 , без изменения коэффициента корреляции. (Это справедливо как для генеральных, так и для выборочных коэффициентов корреляции Пирсона.) Обратите внимание, что более общие линейные преобразования действительно изменяют корреляцию: см.§ Декорреляция n случайных величин для применения.

Интерпретация [ править ]

Диапазоны коэффициент корреляции от -1 до 1. значения A 1 означает , что линейное уравнение описывает взаимосвязь между X и Y отлично, причем все точки данных , лежащих на линии , для которых Y возрастает по мере X возрастает. Значение -1 означает, что все точки данных лежат на линии, для которой Y уменьшается с увеличением X. Значение 0 означает, что между переменными нет линейной корреляции. [14]

В более общем плане отметим, что ( X i - X ) ( Y i - Y ) положительно тогда и только тогда, когда X i и Y i лежат на одной стороне от своих соответствующих средних. Таким образом, коэффициент корреляции является положительным, если X i и Y i имеют тенденцию одновременно быть больше или одновременно меньше, чем их соответствующие средние значения. Коэффициент корреляции отрицательный ( антикорреляция ), если X i и Y iимеют тенденцию лежать по разные стороны от своих средств. Причем, чем сильнее тенденция, тем больше абсолютное значение коэффициента корреляции.

Роджерс и Найсвандер [15] каталогизировали тринадцать способов интерпретации корреляции:

- Функция исходных оценок и средних значений

- Стандартизированная ковариация

- Стандартизированный наклон линии регрессии

- Среднее геометрическое двух наклонов регрессии

- Корень квадратный из отношения двух дисперсий

- Среднее перекрестное произведение стандартизованных переменных

- Функция угла между двумя стандартизованными линиями регрессии

- Функция угла между двумя переменными векторами

- Измененная дисперсия разницы между стандартизованными баллами

- Оценка по правилу балуна

- Связанные с двумерными эллипсами изоконцентрации

- Функция тестовой статистики из запланированных экспериментов

- Соотношение двух средних

Геометрическая интерпретация [ править ]

Для нецентрированных данных существует связь между коэффициентом корреляции и углом φ между двумя линиями регрессии, y = g X ( x ) и x = g Y ( y ) , полученными путем регрессии y по x и x по y соответственно. (Здесь φ измеряется против часовой стрелки в первом квадранте, образованном вокруг точки пересечения линий, если r > 0 , или против часовой стрелки от четвертого во второй квадрант, если r <0.) Можно показать [16], что если стандартные отклонения равны, то r = sec φ - tan φ , где sec и tan - тригонометрические функции .

Для центрированных данных (то есть, данные , которые были сдвинуты на выборки посредством их соответствующих переменных так, чтобы иметь в среднем от нуля для каждого переменного), коэффициента корреляции можно также рассматривать как косинус этого угла & thetas между двумя Наблюдаемыми векторы в N -мерном пространстве (для N наблюдений каждой переменной) [17]

Для набора данных можно определить как нецентрированные (несовместимые с Пирсоном), так и центрированные коэффициенты корреляции. В качестве примера предположим, что в пяти странах валовой национальный продукт составляет 1, 2, 3, 5 и 8 миллиардов долларов соответственно. Предположим, что в этих пяти странах (в том же порядке) бедность составляет 11%, 12%, 13%, 15% и 18%. Затем пусть x и y будут упорядоченными 5-элементными векторами, содержащими указанные выше данные: x = (1, 2, 3, 5, 8) и y = (0.11, 0.12, 0.13, 0.15, 0.18) .

При обычной процедуре нахождения угла θ между двумя векторами (см. Скалярное произведение ) нецентрированный коэффициент корреляции равен:

Этот нецентрированный коэффициент корреляции идентичен косинусному подобию . Обратите внимание, что приведенные выше данные были намеренно выбраны так, чтобы они идеально коррелировали: y = 0,10 + 0,01 x . Следовательно, коэффициент корреляции Пирсона должен быть равен единице. Центрирование данных (сдвиг x на ℰ ( x ) = 3,8 и y на ℰ ( y ) = 0,138 ) дает x = (−2,8, −1,8, −0,8, 1,2, 4,2) и y = (−0,028, −0,018, -0,008, 0,012, 0,042) , из которых

как и ожидалось.

Интерпретация размера корреляции [ править ]

Несколько авторов предложили рекомендации по интерпретации коэффициента корреляции. [18] [19] Однако все такие критерии в некотором смысле произвольны. [19] Интерпретация коэффициента корреляции зависит от контекста и целей. Корреляция 0,8 может быть очень низкой, если кто-то проверяет физический закон с использованием высококачественных инструментов, но может считаться очень высокой в социальных науках, где может быть больший вклад усложняющих факторов.

Вывод [ править ]

Статистический вывод, основанный на коэффициенте корреляции Пирсона, часто фокусируется на одной из следующих двух целей:

- Одна из целей состоит в том, чтобы проверить нулевую гипотезу о том, что истинный коэффициент корреляции ρ равен 0, на основе значения выборочного коэффициента корреляции r .

- Другая цель - получить доверительный интервал, который при повторной выборке имеет заданную вероятность содержания ρ .

Ниже мы обсудим методы достижения одной или обеих этих целей.

Использование теста перестановки [ править ]

Перестановочные тесты обеспечивают прямой подход к выполнению проверки гипотез и построению доверительных интервалов. Проверка перестановки коэффициента корреляции Пирсона включает следующие два этапа:

- Используя исходные парные данные ( x i , y i ), случайным образом переопределите пары, чтобы создать новый набор данных ( x i , y i ' ), где i' - это перестановка набора {1, ..., n }. Перестановка i ' выбирается случайным образом с равными вероятностями для всех n ! возможные перестановки. Это эквивалентно отрисовке i ' случайным образом без замены из набора {1, ..., n }. В бутстрэппинге , тесно связанном подходе, i и i ′равны и тянутся с заменой из {1, ..., n };

- Постройте коэффициент корреляции r из рандомизированных данных.

Чтобы выполнить проверку перестановки, повторите шаги (1) и (2) большое количество раз. Значение p для теста перестановки - это доля значений r, сгенерированных на этапе (2), которые больше, чем коэффициент корреляции Пирсона, рассчитанный на основе исходных данных. Здесь «больше» может означать, что значение больше по величине или больше по значению со знаком, в зависимости от того, требуется ли двусторонний или односторонний тест.

Использование бутстрапа [ править ]

Самозагрузки могут быть использованы для построения доверительных интервалов для коэффициента корреляции Пирсона. В «непараметрическом» бутстрапе n пар ( x i , y i ) повторно дискретизируются «с заменой» из наблюдаемого набора из n пар, и коэффициент корреляции r вычисляется на основе данных повторной дискретизации. Этот процесс повторяется большое количество раз, и эмпирическое распределение повторно выбранных значений r используется для аппроксимации выборочного распределения статистики. 95% доверительный интервал для ρможет быть определен как интервал от 2,5 до 97,5 процентиля повторно выбранных значений r .

Тестирование с использованием t- распределения Стьюдента [ править ]

Для пар из нескоррелированого двухмерного нормального распределения , то распределение выборки определенной функции коэффициента корреляции Пирсона следующим образом Стьюдента т -распределение с степенями свободы п - 2. В частности, если базовые переменные являются белыми и имеют двумерный нормальное распределение, то переменные

имеет t -распределение Стьюдента в нулевом случае (нулевая корреляция). [20] Это примерно справедливо в случае ненормальных наблюдаемых значений, если размеры выборки достаточно велики. [21] Для определения критических значений r необходима обратная функция:

В качестве альтернативы можно использовать асимптотические подходы с большой выборкой.

В другой ранней статье [22] представлены графики и таблицы для общих значений ρ для малых размеров выборки, а также обсуждаются вычислительные подходы.

В случае, когда базовые переменные не белые, выборочное распределение коэффициента корреляции Пирсона следует t- распределению Стьюдента, но степени свободы уменьшаются. [23]

Использование точного распределения [ править ]

Для данных, которые подчиняются двумерному нормальному распределению , точная функция плотности f ( r ) для выборочного коэффициента корреляции r нормального двумерного параметра равна [24] [25] [26]

где это гамма - функция и является гауссовой гипергеометрической функцией .

В частном случае, когда точная функция плотности f ( r ) может быть записана как:

где - бета-функция , которая является одним из способов записи плотности t-распределения Стьюдента, как указано выше.

Использование преобразования Фишера [ править ]

На практике, доверительные интервалы и проверки гипотез , относящихся к р, как правило , осуществляется с помощью преобразования Фишера , :

F ( r ) приблизительно следует нормальному распределению с

- и стандартная ошибка

где n - размер выборки. Ошибка аппроксимации является самой низкой для большого размера выборки и малой и и увеличивается в противном случае.

Используя приближение, z-показатель равен

при нулевой гипотезе , что , учитывая предположение , что выборочные пары независимы и одинаково распределены и следовать двумерное нормальное распределение . Таким образом, приблизительное p-значение может быть получено из нормальной таблицы вероятностей. Например, если наблюдается z = 2,2 и требуется двустороннее значение p для проверки нулевой гипотезы, что значение p равно 2 · Φ (−2,2) = 0,028, где Φ - стандартная нормальная кумулятивная функция распределения. .

Чтобы получить доверительный интервал для ρ, мы сначала вычисляем доверительный интервал для F ( ):

Обратное преобразование Фишера возвращает интервал к шкале корреляции.

Например, предположим, что мы наблюдаем r = 0,3 с размером выборки n = 50, и мы хотим получить 95% доверительный интервал для ρ. Преобразованное значение составляет arctanh ( r ) = 0,30952, поэтому доверительный интервал на преобразованной шкале составляет 0,30952 ± 1,96 / √ 47 или (0,023624, 0,595415). Возврат к шкале корреляции дает (0,024, 0,534).

Регрессионный анализ методом наименьших квадратов [ править ]

Квадрат выборочного коэффициента корреляции обычно обозначается r 2 и является частным случаем коэффициента детерминации . В этом случае он оценивает долю дисперсии Y, которая объясняется X в простой линейной регрессии . Итак, если у нас есть наблюдаемый набор данных и подобранный набор данных, тогда в качестве отправной точки общее изменение Y i вокруг их среднего значения может быть разложено следующим образом

где - подогнанные значения из регрессионного анализа. Это можно изменить, чтобы получить

Два слагаемых выше представляют собой долю дисперсии в Y, которая объясняется X (справа) и не объясняется X (слева).

Затем мы применяем свойство моделей регрессии по методу наименьших квадратов, согласно которому ковариация выборки между и равна нулю. Таким образом, можно записать выборочный коэффициент корреляции между наблюдаемыми и подобранными значениями отклика в регрессии (расчет не соответствует ожиданиям, предполагает гауссову статистику)

Таким образом

куда

- это доля дисперсии Y объясняется линейной функцией от X .

В приведенном выше выводе тот факт, что

можно доказать, заметив, что частные производные остаточной суммы квадратов ( RSS ) по β 0 и β 1 равны 0 в модели наименьших квадратов, где

- .

В конце концов, уравнение можно записать как:

куда

Символ называется суммой квадратов регрессии, также называемой объясненной суммой квадратов , и представляет собой общую сумму квадратов (пропорциональную дисперсии данных).

Чувствительность к распределению данных [ править ]

Существование [ править ]

Коэффициент корреляции Пирсона совокупности определяется в терминах моментов и, следовательно, существует для любого двумерного распределения вероятностей, для которого определена ковариация совокупности и определены маргинальные дисперсии совокупности , которые не равны нулю. Некоторые распределения вероятностей, такие как распределение Коши, имеют неопределенную дисперсию, и, следовательно, ρ не определено, если X или Y следуют такому распределению. В некоторых практических приложениях, например, с данными, предположительно подчиняющимися распределению с тяжелым хвостом. , это важное соображение. Однако наличие коэффициента корреляции обычно не вызывает беспокойства; например, если диапазон распределения ограничен, всегда определяется ρ.

Размер выборки [ править ]

- Если размер выборки средний или большой, а совокупность нормальная, то в случае двумерного нормального распределения коэффициент корреляции выборки является оценкой максимального правдоподобия коэффициента корреляции совокупности, асимптотически несмещенной и эффективной , что примерно означает что невозможно построить более точную оценку, чем выборочный коэффициент корреляции.

- Если размер выборки велик, а совокупность ненормальна, то коэффициент корреляции выборки остается приблизительно несмещенным, но может быть неэффективным.

- Если размер выборки большой, то коэффициент корреляции выборки является непротиворечивой оценкой коэффициента корреляции совокупности до тех пор, пока средние выборки, дисперсии и ковариация согласованы (что гарантируется, когда может применяться закон больших чисел ).

- Если размер выборки невелик, то коэффициент корреляции выборки r не является несмещенной оценкой ρ . [10] Вместо этого следует использовать скорректированный коэффициент корреляции: см. Определение в другом месте этой статьи.

- Корреляции могут быть разными для несбалансированных дихотомических данных, когда в выборке есть ошибка дисперсии. [27]

Надежность [ править ]

Как и во многих широко используемых статистических данных, выборка статистики г не надежный , [28] , поэтому его значение может ввести в заблуждение , если выбросы присутствуют. [29] [30] В частности, PMCC не является ни устойчивым с точки зрения распределения, [ необходима ссылка ], ни устойчивостью к выбросам [28] (см. « Надежная статистика # Определение» ). Проверка диаграммы рассеяния между X и Yобычно выявляет ситуацию, когда отсутствие устойчивости может быть проблемой, и в таких случаях может быть целесообразно использовать надежную меру ассоциации. Однако обратите внимание, что, хотя большинство надежных оценок ассоциации каким-то образом измеряют статистическую зависимость , они, как правило, не интерпретируются в той же шкале, что и коэффициент корреляции Пирсона.

Статистический вывод для коэффициента корреляции Пирсона чувствителен к распределению данных. Точные тесты и асимптотические тесты, основанные на преобразовании Фишера, могут применяться, если данные приблизительно нормально распределены, но в противном случае могут вводить в заблуждение. В некоторых ситуациях бутстрап может применяться для построения доверительных интервалов, а тесты перестановки могут применяться для выполнения тестов гипотез. Эти непараметрические подходы могут дать более значимые результаты в некоторых ситуациях, когда двумерная нормальность не выполняется. Однако стандартные версии этих подходов полагаются на возможность замены. данных, что означает отсутствие упорядочения или группировки анализируемых пар данных, которые могли бы повлиять на поведение оценки корреляции.

Стратифицированный анализ - это один из способов либо учесть отсутствие двумерной нормальности, либо изолировать корреляцию, возникающую в результате одного фактора, при одновременном контроле другого. Если W представляет принадлежность к кластеру или другой фактор, который желательно контролировать, мы можем стратифицировать данные на основе значения W , а затем рассчитать коэффициент корреляции в пределах каждой страты. Оценки прослойки уровня могут затем быть объединены , чтобы оценить общую корреляцию, контролируя при этом для W . [31]

Варианты [ править ]

Вариации коэффициента корреляции можно рассчитывать для разных целей. Вот несколько примеров.

Скорректированный коэффициент корреляции [ править ]

Коэффициент корреляции выборки r не является объективной оценкой ρ . Для данных, которые подчиняются двумерному нормальному распределению , математическое ожидание E [ r ] для выборочного коэффициента корреляции r нормального двумерного показателя составляет [32]

- поэтому r - смещенная оценка

Уникальная несмещенная оценка минимальной дисперсии r adj дается формулой [33]

куда:

- определены, как указано выше,

- - гипергеометрическая функция Гаусса .

Приблизительно несмещенная оценка r adj может быть получена [ необходима цитата ] путем усечения E [ r ] и решения этого усеченного уравнения:

Приближенное решение [ необходимая цитата ] уравнения (2):

где в (3):

- определены, как указано выше,

- r adj - неоптимальная оценка, [ необходима цитата ] [ требуется пояснение ]

- r adj также можно получить, максимизируя log ( f ( r )),

- r adj имеет минимальную дисперсию для больших значений n ,

- г прил имеет уклон порядка 1 / ( п - 1) .

Другой предлагаемый [10] скорректированный коэффициент корреляции: [ необходима цитата ]

Обратите внимание, что r adj ≈ r для больших значений n .

Взвешенный коэффициент корреляции [ править ]

Предположим, что коррелируемые наблюдения имеют разную степень важности, которая может быть выражена весовым вектором w . Чтобы вычислить корреляцию между векторами x и y с вектором весов w (все длины n ), [34] [35]

- Средневзвешенное значение:

- Взвешенная ковариация

- Взвешенная корреляция

Коэффициент корреляции отражения [ править ]

Отражательная корреляция - это вариант корреляции Пирсона, в которой данные не сосредоточены вокруг своих средних значений. [ необходима цитата ] Корреляция отражения населения

Отражательная корреляция симметрична, но не инвариантна при переводе:

Отражательная корреляция выборки эквивалентна косинусному подобию :

Взвешенная версия выборочной корреляции отражательной способности:

Масштабированный коэффициент корреляции [ править ]

Масштабированная корреляция - это вариант корреляции Пирсона, в котором диапазон данных ограничен намеренно и контролируемым образом, чтобы выявить корреляции между быстрыми компонентами во временных рядах. [36] Масштабная корреляция определяется как средняя корреляция между короткими сегментами данных.

Позвольте быть количеством сегментов, которые могут поместиться в общую длину сигнала для данного масштаба :

Масштабированная корреляция по всем сигналам затем вычисляется как

где - коэффициент корреляции Пирсона для сегмента .

При выборе параметра диапазон значений уменьшается, и корреляции на большом временном масштабе отфильтровываются, выявляются только корреляции на коротком временном масштабе. Таким образом, вклад медленных компонентов удаляется, а вклад быстрых компонентов сохраняется.

Расстояние Пирсона [ править ]

Метрика расстояния для двух переменных X и Y, известная как расстояние Пирсона, может быть определена по их коэффициенту корреляции как [37]

Учитывая, что коэффициент корреляции Пирсона находится между [-1, +1], расстояние Пирсона лежит в [0, 2]. Расстояние Пирсона использовалось в кластерном анализе и обнаружении данных для связи и хранения с неизвестным усилением и смещением [38]

Коэффициент круговой корреляции [ править ]

Для переменных X = { x 1 , ..., x n } и Y = { y 1 , ..., y n }, которые определены на единичной окружности [0, 2 π ), можно определить круговую аналог коэффициента Пирсона. [39] Это делается путем преобразования точек данных в X и Y с помощью синусоидальной функции, так что коэффициент корреляции задается как:

где и являются круговыми средствами из X и Y . Эта мера может быть полезна в таких областях, как метеорология, где важно угловое направление данных.

Частичная корреляция [ править ]

Если совокупность или набор данных характеризуется более чем двумя переменными, частичный коэффициент корреляции измеряет силу зависимости между парой переменных, которая не учитывается тем, как они обе изменяются в ответ на вариации в выбранном подмножестве. других переменных.

Декорреляция n случайных величин [ править ]

Всегда можно удалить корреляции между всеми парами произвольного числа случайных величин с помощью преобразования данных, даже если связь между переменными является нелинейной. Представление этого результата для распределения населения дано Cox & Hinkley. [40]

Соответствующий результат существует для уменьшения выборочных корреляций до нуля. Предположим, что вектор из n случайных величин наблюдается m раз. Пусть X - матрица, где - j- я переменная наблюдения i . Пусть будет квадратная матрица размером m на m с каждым элементом 1. Тогда D - это данные, преобразованные таким образом, чтобы каждая случайная переменная имела нулевое среднее, а T - это данные, преобразованные таким образом, чтобы все переменные имели нулевое среднее значение и нулевую корреляцию со всеми другими переменными - выборочная корреляция. матрица из Тбудет единичной матрицей. Это должно быть дополнительно разделено на стандартное отклонение, чтобы получить единичную дисперсию. Преобразованные переменные не будут коррелированы, даже если они не могут быть независимыми .

где показатель - 1 ⁄ 2 представляет матричный квадратный корень из обратной матрицы. Корреляционная матрица T будет единичной матрицей. Если новое наблюдение данных x представляет собой вектор-строку из n элементов, то такое же преобразование может быть применено к x, чтобы получить преобразованные векторы d и t :

Эта декорреляция связана с анализом главных компонентов для многомерных данных.

Программные реализации [ править ]

- Базовый пакет статистики R реализует тест cor.test(x, y, method = "pearson")в своем пакете "stats" (также

cor(x, y, method = "pearson")будет работать, но без возврата p-значения). Поскольку по умолчанию используется pearson, аргумент метода также можно не указывать. - Модуль статистических функций Python реализует тест pearsonr(x, y)в своем модуле scipy.stats и возвращает коэффициент корреляции r и p-значение как (r, p-value).

- Библиотека Python Pandas реализует расчет коэффициента корреляции Пирсона как параметр по умолчанию для метода.pandas.DataFrame.corr

См. Также [ править ]

- Квартет анскомба

- Ассоциация (статистика)

- Коэффициент коллигации

- Q Yule's

- Yule's Y

- Коэффициент корреляции согласованности

- Корреляция и зависимость

- Коэффициент корреляции

- Ослабление

- Корреляция расстояний

- Максимальный информационный коэффициент

- Множественная корреляция

- Нормально распределенный и некоррелированный не подразумевает независимого

- Соотношение шансов

- Частичная корреляция

- Полихорическая корреляция

- Соотношение числа квадрантов

- Коэффициент RV

- Коэффициент ранговой корреляции Спирмена

Сноски [ править ]

- ↑ Еще в 1877 году Гальтон использовал термин «реверсия» и символ « r » дляобозначениятого, что впоследствии стало «регрессией». [2] [3] [4]

Ссылки [ править ]

- ^ «Учебники SPSS: корреляция Пирсона» .

- ↑ Гальтон, Ф. (5–19 апреля 1877 г.). «Типичные законы наследственности» . Природа . 15 (388, 389, 390): 492–495, 512–514, 532–533. Bibcode : 1877Natur..15..492. . DOI : 10.1038 / 015492a0 . S2CID 4136393 . В «Приложении» на стр. 532 Гальтон использует термин «реверсия» и символ r .

- ^ Гальтон, Ф. (24 сентября 1885 г.). «Британская ассоциация: Секция II, Антропология: вступительное слово Фрэнсиса Гальтона, ФРС и др., Президента Антропологического института, президента секции» . Природа . 32 (830): 507–510.

- ^ Гальтон, Ф. (1886). «Регресс к посредственности в наследственном росте» . Журнал Антропологического института Великобритании и Ирландии . 15 : 246–263. DOI : 10.2307 / 2841583 . JSTOR 2841583 .

- ↑ Пирсон, Карл (20 июня 1895 г.). «Заметки о регрессе и наследовании в случае двух родителей» . Труды Лондонского королевского общества . 58 : 240–242. Bibcode : 1895RSPS ... 58..240P .

- ^ Стиглер, Стивен М. (1989). «Отчет Фрэнсиса Гальтона об изобретении корреляции» . Статистическая наука . 4 (2): 73–79. DOI : 10,1214 / сс / 1177012580 . JSTOR 2245329 .

- ^ "Проанализируйте математический анализ вероятностей ошибок в ситуации" . Mem. Акад. Рой. Sci. Inst. Франция . Sci. Math, et Phys. (На французском). 9 : 255–332. 1844 г. - через Google Книги.

- ^ Райт, С. (1921). «Корреляция и причинно-следственная связь». Журнал сельскохозяйственных исследований . 20 (7): 557–585.

- ^ a b «Список вероятностных и статистических символов» . Математическое хранилище . 26 апреля 2020 . Проверено 22 августа 2020 .

- ^ a b c d e Реальная статистика с использованием Excel: корреляция: основные концепции , получено 22 февраля 2015 г.

- ^ Вайсштейн, Эрик В. «Статистическая корреляция» . mathworld.wolfram.com . Проверено 22 августа 2020 .

- ^ Мория, Н. (2008). "Многомерный оптимальный совместный анализ, связанный с шумом в продольных случайных процессах". В Ян, Фэншань (ред.). Прогресс в прикладном математическом моделировании . Nova Science Publishers, Inc., стр. 223–260. ISBN 978-1-60021-976-4.

- ^ Garren, Стивен Т. (15 июня 1998). «Оценка максимального правдоподобия коэффициента корреляции в двумерной нормальной модели с отсутствующими данными». Статистика и вероятностные письма . 38 (3): 281–288. DOI : 10.1016 / S0167-7152 (98) 00035-2 .

- ^ «Вводная бизнес-статистика: коэффициент корреляции r» . opentextbc.ca . Проверено 21 августа 2020 .

- ^ Роджерс; Ничевандер (1988). «Тринадцать способов взглянуть на коэффициент корреляции» (PDF) . Американский статистик . 42 (1): 59–66. DOI : 10.2307 / 2685263 . JSTOR 2685263 .

- Перейти ↑ Schmid, John Jr. (декабрь 1947 г.). «Связь между коэффициентом корреляции и углом между линиями регрессии». Журнал образовательных исследований . 41 (4): 311–313. DOI : 10.1080 / 00220671.1947.10881608 . JSTOR 27528906 .

- Перейти ↑ Rummel, RJ (1976). «Понимание корреляции» . гл. 5 (как показано для особого случая в следующем абзаце).

- ^ Буда, Анджей; Ярыновский, Анджей (декабрь 2010 г.). Время жизни корреляций и его приложения . Wydawnictwo Niezależne. С. 5–21. ISBN 9788391527290.

- ^ а б Коэн, Дж. (1988). Статистический анализ мощности для поведенческих наук (2-е изд.).

- ^ Рахман, Н. А. (1968) Курс теоретической статистики , Чарльз Гриффин и компания, 1968

- Перейти ↑ Kendall, MG, Stuart, A. (1973) Advanced Theory of Statistics, Volume 2: Inference and Relationship , Griffin. ISBN 0-85264-215-6 (Раздел 31.19)

- ^ Сопер, ОН ; Янг, AW; Пещера, BM; Ли, А .; Пирсон, К. (1917). «О распределении коэффициента корреляции в малых выборках. Приложение II к статьям« Студента »и Р.А. Фишера. Совместное исследование» . Биометрика . 11 (4): 328–413. DOI : 10.1093 / Biomet / 11.4.328 .

- ^ Дэйви, Кэтрин Е .; Grayden, Дэвид Б .; Иган, Гэри Ф .; Джонстон, Ли А. (январь 2013 г.). «Фильтрация вызывает корреляцию в данных состояния покоя фМРТ». NeuroImage . 64 : 728–740. DOI : 10.1016 / j.neuroimage.2012.08.022 . ЛВП : 11343/44035 . PMID 22939874 . S2CID 207184701 .

- ^ Hotelling, Гарольд (1953). «Новый взгляд на коэффициент корреляции и его преобразования». Журнал Королевского статистического общества . Серия Б (Методическая). 15 (2): 193–232. DOI : 10.1111 / j.2517-6161.1953.tb00135.x . JSTOR 2983768 .

- ^ Кенни, JF; Хранение, ES (1951). Математика статистики . Часть 2 (2-е изд.). Принстон, Нью-Джерси: Ван Ностранд.

- ^ Вайсштейн, Эрик В. "Коэффициент корреляции - двумерное нормальное распределение" . mathworld.wolfram.com .

- ^ Лай, Чун Синг; Дао, Иншань; Сюй, Фанъюань; Ng, Wing WY; Цзя, Ювэй; Юань, Хаолян; Хуанг, Чао; Лай, Лой Лей; Сюй, Чжао; Локателли, Джорджио (январь 2019 г.). «Надежная структура корреляционного анализа несбалансированных и дихотомических данных с неопределенностью» (PDF) . Информационные науки . 470 : 58–77. DOI : 10.1016 / j.ins.2018.08.017 .

- ^ a b Уилкокс, Рэнд Р. (2005). Введение в робастную оценку и проверку гипотез . Академическая пресса.

- ^ Девлин, Сьюзен Дж .; Gnanadesikan, R .; Кеттенринг-младший (1975). «Надежная оценка и обнаружение выбросов с коэффициентами корреляции». Биометрика . 62 (3): 531–545. DOI : 10.1093 / Biomet / 62.3.531 . JSTOR 2335508 .

- ^ Хубер, Питер. Дж. (2004). Надежная статистика . Вайли.[ требуется страница ]

- ^ Кац., Митчелл Х. (2006) Многопараметрический анализ - Практическое руководство для клиницистов . 2-е издание. Издательство Кембриджского университета. ISBN 978-0-521-54985-1 . ISBN 0-521-54985-X doi : 10.2277 / 052154985X

- ^ Hotelling, H. (1953). «Новый взгляд на коэффициент корреляции и его преобразования». Журнал Королевского статистического общества. Серия Б (Методическая) . 15 (2): 193–232. DOI : 10.1111 / j.2517-6161.1953.tb00135.x . JSTOR 2983768 .

- ^ Олкин, Ингрэм; Пратт, Джон В. (март 1958 г.). «Беспристрастная оценка некоторых коэффициентов корреляции» . Летопись математической статистики . 29 (1): 201–211. DOI : 10.1214 / АОМ / 1177706717 . JSTOR 2237306 . .

- ^ «Re: вычислить взвешенную корреляцию» . sci.tech-archive.net .

- ^ «Взвешенная матрица корреляции - Обмен файлами - MATLAB Central» .

- ^ Николич, D; Муресан, RC; Фен, Вт; Певица, W (2012). «Масштабированный корреляционный анализ: лучший способ вычисления кросс-коррелограммы» (PDF) . Европейский журнал нейробиологии . 35 (5): 1-21. DOI : 10.1111 / j.1460-9568.2011.07987.x . PMID 22324876 . S2CID 4694570 .

- ^ Fulekar (Ed.), MH (2009) Биоинформатика: Применение в жизни и наук об окружающей среде , Springer (. С. 110) ISBN 1-4020-8879-5

- ^ Имминк, К. Шухамер; Вебер, Дж. (Октябрь 2010 г.). «Обнаружение минимального расстояния Пирсона для многоуровневых каналов с рассогласованием по усилению и / или смещению» . IEEE Transactions по теории информации . 60 (10): 5966–5974. CiteSeerX 10.1.1.642.9971 . DOI : 10,1109 / tit.2014.2342744 . S2CID 1027502 . Проверено 11 февраля 2018 .

- ^ Джаммаламадака, С. Рао; СенГупта, А. (2001). Темы в круговой статистике . Нью-Джерси: World Scientific. п. 176. ISBN. 978-981-02-3778-3. Проверено 21 сентября 2016 года .

- ^ Кокс, DR; Хинкли, Д.В. (1974). Теоретическая статистика . Чепмен и Холл. Приложение 3. ISBN 0-412-12420-3.

Внешние ссылки [ править ]

| В Викиверситете есть учебные ресурсы о линейной корреляции |

- "кокор" . comparingcorrelations.org . - Бесплатный веб-интерфейс и пакет R для статистического сравнения двух зависимых или независимых корреляций с перекрывающимися или неперекрывающимися переменными.

- «Корреляция» . nagysandor.eu . - интерактивное Flash-моделирование корреляции двух нормально распределенных переменных.

- «Калькулятор коэффициента корреляции» . hackmath.net . Линейная регрессия. -

- «Критические значения коэффициента корреляции Пирсона» (PDF) . frank.mtsu.edu/~dkfuller . - большой стол.

- «Угадай соотношение» . - Игра, в которой игроки угадывают, насколько коррелированы две переменные на диаграмме рассеяния, чтобы лучше понять концепцию корреляции.

![{\ Displaystyle \ OperatorName {cov} (X, Y) = \ OperatorName {\ mathbb {E}} [(X- \ mu _ {X}) (Y- \ mu _ {Y})],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1e88bc4ba085b98d5cca09b958ad378d50127308)

![{\ displaystyle \ rho _ {X, Y} = {\ frac {\ operatorname {\ mathbb {E}} [(X- \ mu _ {X}) (Y- \ mu _ {Y})]} {\ сигма _ {X} \ sigma _ {Y}}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/042c646e848d2dc6e15d7b5c7a5b891941b2eab6)

![{\ Displaystyle \ mu _ {X} = \ OperatorName {\ mathbb {E}} [\, X \,]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1182bdcc66a113596e3ece07a0acbeda8d56d483)

![{\ Displaystyle \ му _ {Y} = \ OperatorName {\ mathbb {E}} [\, Y \,]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b2f14f5eda9d726e57048a2c56889912a80a06b6)

![{\ displaystyle \ sigma _ {X} ^ {2} = \ operatorname {\ mathbb {E}} [\, \ left (X- \ operatorname {\ mathbb {E}} [X] \ right) ^ {2} \,] = \ operatorname {\ mathbb {E}} [\, X ^ {2} \,] - \ left (\ operatorname {\ mathbb {E}} [\, X \,] \ right) ^ {2 }}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cbf27c91550c7c82ee7e9e948673eb99da1a7378)

![{\ displaystyle \ sigma _ {Y} ^ {2} = \ operatorname {\ mathbb {E}} [\, \ left (Y- \ operatorname {\ mathbb {E}} [Y] \ right) ^ {2} \,] = \ OperatorName {\ mathbb {E}} [\, Y ^ {2} \,] - \ left (\, \ operatorname {\ mathbb {E}} [\, Y \,] \ right) ^ {2}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ed498483dae15dbb86e957b5a1463f5536885902)

![{\ Displaystyle \ OperatorName {\ mathbb {E}} [\, \ left (X- \ mu _ {X} \ right) \ left (Y- \ mu _ {Y} \ right) \,] = \ operatorname { \ mathbb {E}} [\, \ left (X- \ operatorname {\ mathbb {E}} [\, X \,] \ right) \ left (Y- \ operatorname {\ mathbb {E}} [\, Y \,] \ right) \,] = \ operatorname {\ mathbb {E}} [\, X \, Y \,] - \ operatorname {\ mathbb {E}} [\, X \,] \ operatorname { \ mathbb {E}} [\, Y \,] \ ,,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4443378e105084380438782ebd391f8cb0e8e048)

![{\ displaystyle \ rho _ {X, Y} = {\ frac {\ operatorname {\ mathbb {E}} [\, X \, Y \,] - \ operatorname {\ mathbb {E}} [\, X \ ,] \ operatorname {\ mathbb {E}} [\, Y \,]} {{\ sqrt {\ operatorname {\ mathbb {E}} [\, X ^ {2} \,] - \ left (\ operatorname {\ mathbb {E}} [\, X \,] \ right) ^ {2}}} ~ {\ sqrt {\ operatorname {\ mathbb {E}} [\, Y ^ {2} \,] - \ left (\ operatorname {\ mathbb {E}} [\, Y \,] \ right) ^ {2}}}}}.}.](https://wikimedia.org/api/rest_v1/media/math/render/svg/0a96c914bb811b84698b4d4118794cf4c8167ca7)

![z = {\ frac {x - {\ text {mean}}} {\ text {SE}}} = [F (r) -F (\ rho _ {0})] {\ sqrt {n-3}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/da7a3d54a70f9005e3bf9a2accf62cbf0fa0ea71)

![{\ displaystyle 100 (1- \ alpha) \% {\ text {CI}}: \ operatorname {arctanh} (\ rho) \ in [\ operatorname {arctanh} (r) \ pm z _ {\ alpha / 2} { \ text {SE}}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/98ccdd57a6dba17340228d97aa9d37f00070c2f0)

![{\ displaystyle 100 (1- \ alpha) \% {\ text {CI}}: \ rho \ in [\ operatorname {tanh} (\ operatorname {arctanh} (r) -z _ {\ alpha / 2} {\ text {SE}}), \ operatorname {tanh} (\ operatorname {arctanh} (r) + z _ {\ alpha / 2} {\ text {SE}})]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/068d979b7f0c30c080bf11249a2018addd71b067)

![{\ displaystyle {\ begin {align} r (Y, {\ hat {Y}}) & = {\ frac {\ sum _ {i} (Y_ {i} - {\ bar {Y}}) ({\ шляпа {Y}} _ {i} - {\ bar {Y}})} {\ sqrt {\ sum _ {i} (Y_ {i} - {\ bar {Y}}) ^ {2} \ cdot \ sum _ {i} ({\ hat {Y}} _ {i} - {\ bar {Y}}) ^ {2}}}} \\ [6pt] & = {\ frac {\ sum _ {i} (Y_ {i} - {\ hat {Y}} _ {i} + {\ hat {Y}} _ {i} - {\ bar {Y}}) ({\ hat {Y}} _ {i} - {\ bar {Y}})} {\ sqrt {\ sum _ {i} (Y_ {i} - {\ bar {Y}}) ^ {2} \ cdot \ sum _ {i} ({\ hat {Y}} _ {i} - {\ bar {Y}}) ^ {2}}}} \\ [6pt] & = {\ frac {\ sum _ {i} [(Y_ {i} - {\ hat {Y}} _ {i}) ({\ hat {Y}} _ {i} - {\ bar {Y}}) + ({\ hat {Y}} _ {i} - {\ bar {Y }}) ^ {2}]} {\ sqrt {\ sum _ {i} (Y_ {i} - {\ bar {Y}}) ^ {2} \ cdot \ sum _ {i} ({\ hat { Y}} _ {i} - {\ bar {Y}}) ^ {2}}}} \\ [6pt] & = {\ frac {\ sum _ {i} ({\ hat {Y}} _ { i} - {\ bar {Y}}) ^ {2}} {\ sqrt {\ sum _ {i} (Y_ {i} - {\ bar {Y}}) ^ {2} \ cdot \ sum _ { i} ({\ hat {Y}} _ {i} - {\ bar {Y}}) ^ {2}}}} \\ [6pt] & = {\ sqrt {\ frac {\ sum _ {i} ({\ hat {Y}} _ {i} - {\ bar {Y}}) ^ {2}} {\ sum _ {i} (Y_ {i} - {\ bar {Y}}) ^ {2 }}}}.\ конец {выровнено}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d86595f3f77e8ee96952760d9176a5fa140cc562)

![{\ displaystyle \ operatorname {\ mathbb {E}} \ left [r \ right] = \ rho - {\ frac {\ rho \ left (1- \ rho ^ {2} \ right)} {2n}} + \ cdots, \ quad}](https://wikimedia.org/api/rest_v1/media/math/render/svg/683b838e709e3b32a3c22dfec4fa665a593f42ad)

![{\ displaystyle (2) \ qquad r = \ operatorname {\ mathbb {E}} [r] \ приблизительно r _ {\ text {adj}} - {\ frac {r _ {\ text {adj}} (1-r_ { \ text {adj}} ^ {2})} {2n}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/356efd2f9fb8f8d5ca3e49ff49bca1b73f6efd63)

![{\ displaystyle (3) \ qquad r _ {\ text {adj}} \ приблизительно r \ left [1 + {\ frac {1-r ^ {2}} {2n}} \ right],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ffae18e6ffe588be6a1fb06552e4a5dd28b6a425)

![{\ displaystyle \ operatorname {corr} _ {r} (X, Y) = {\ frac {\ operatorname {\ mathbb {E}} [\, X \, Y \,]} {\ sqrt {\ operatorname {\ mathbb {E}} [\, X ^ {2} \,] \ cdot \ operatorname {\ mathbb {E}} [\, Y ^ {2} \,]}}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e6d897e4b303a062ed14cc9f88f35f5c8ffc91f7)