В статистике , Деминг регрессии , названный в честь У. Эдвардс Деминг , является модель ошибок в-переменных , которая пытается найти линию наилучшего соответствия для двумерного массива данных. Он отличается от простой линейной регрессии тем, что учитывает ошибки наблюдений как по оси x, так и по оси y . Это частный случай метода наименьших квадратов , который позволяет использовать любое количество предикторов и более сложную структуру ошибок.

Регрессия Деминга эквивалентна оценке максимального правдоподобия модели ошибок в переменных, в которой ошибки для двух переменных считаются независимыми и нормально распределенными , а отношение их дисперсий, обозначаемое δ , известно. [1] На практике это соотношение можно оценить из соответствующих источников данных; однако процедура регрессии не учитывает возможные ошибки при оценке этого отношения.

Регрессия Деминга лишь немного сложнее вычислить по сравнению с простой линейной регрессией . Большинство пакетов статистических программ, используемых в клинической химии, предлагают регрессию Деминга.

Модель была первоначально введена Адкоком (1878 г.), который рассматривал случай δ = 1, а затем, в более общем смысле, Куммеллом (1879 г.) с произвольным δ . Однако их идеи оставались в значительной степени незамеченными более 50 лет, пока они не были возрождены Купманом (1937), а затем еще больше распространены Демингом (1943) . Последняя книга стала настолько популярной в клинической химии и смежных областях, что в этих областях метод даже получил название регрессии Деминга . [2]

Спецификация [ править ]

Предположим, что доступные данные ( y i , x i ) - это измеренные наблюдения «истинных» значений ( y i * , x i * ), которые лежат на линии регрессии:

где ошибки ε и η независимы и отношение их дисперсий предполагается известным:

На практике, Дисперсия и параметры зачастую неизвестны, что усложняет оценку . Обратите внимание, что если метод измерения и является одинаковым, эти отклонения, вероятно, будут равны, так в данном случае.

Мы стремимся найти линейку «наиболее подходящих»

таким образом, чтобы взвешенная сумма квадратов остатков модели была минимизирована: [3]

См. Полный вывод в Jensen (2007) [4] .

Решение [ править ]

Решение может быть выражено через выборочные моменты второй степени. То есть сначала мы вычисляем следующие величины (все суммы идут от i = 1 до n ):

Наконец, оценки параметров модели методом наименьших квадратов будут [5]

Ортогональная регрессия [ править ]

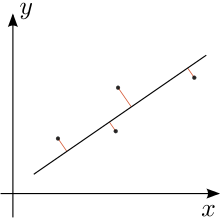

Для случая равных дисперсий ошибок, т. Е. Когда регрессия Деминга становится ортогональной регрессией : она минимизирует сумму квадратов перпендикулярных расстояний от точек данных до линии регрессии . В этом случае обозначьте каждое наблюдение как точку z j на комплексной плоскости (т. Е. Точка ( x j , y j ) записывается как z j = x j + iy j, где i - мнимая единица ). Обозначим как Z сумму квадратов разностей точек данных от центроида.(также обозначается в комплексных координатах), это точка, горизонтальное и вертикальное положение которой являются средними значениями точек данных. Тогда: [6]

- Если Z = 0, то каждая линия, проходящая через центроид, является линией наилучшего ортогонального соответствия [это неверно - возьмите прямоугольник с центром в начале координат, представляющий четыре точки данных и выровненный по горизонтальной и вертикальной осям. Если ширина больше высоты, то лучше подходит ось x, чем ось y].

- Если Z ≠ 0, ортогональная линия регрессии проходит через центроид и параллельна вектору от начала координат до .

Тригонометрические представление ортогональной линии регрессии было дано Кулидж в 1913 году [7]

Заявление [ править ]

В случае трех неколлинеарных точек на плоскости треугольник с этими точками в качестве вершин имеет уникальный эллипс Штейнера, который касается сторон треугольника в их серединах. Большая ось этого эллипса падает на ортогональной линии регрессии для трех вершин. [8]

См. Также [ править ]

- Линия фитинга

Заметки [ править ]

- ^ ( Линнет 1993 )

- ^ Корнблит, Гохман (1979)

- ^ Фуллер, глава 1.3.3

- ^ Дженсен, Андерс Кристиан (2007)

- ^ Glaister (2001)

- ^ Минда и Фелпс (2008), теорема 2.3.

- ^ Кулидж, JL (1913).

- ^ Минда и Фелпс (2008), следствие 2.4.

Ссылки [ править ]

- Адкок, Р. Дж. (1878). «Проблема наименьших квадратов». Аналитик . Анналы математики. 5 (2): 53–54. DOI : 10.2307 / 2635758 . JSTOR 2635758 .

- Кулидж, JL (1913). «Два геометрических приложения математики наименьших квадратов». American Mathematical Monthly . 20 (6): 187–190. DOI : 10.2307 / 2973072 .

- Корнблит, П.Дж.; Гохман, Н. (1979). «Неправильные коэффициенты регрессии методом наименьших квадратов». Clin. Chem . 25 (3): 432–438. PMID 262186 .

- Деминг, WE (1943). Статистическая корректировка данных . Wiley, NY (издание Dover Publications, 1985). ISBN 0-486-64685-8.

- Фуллер, Уэйн А. (1987). Модели ошибок измерения . ISBN компании John Wiley & Sons, Inc. 0-471-86187-1.

- Глэйстер, П. (2001). «Повторное посещение наименьших квадратов». Математический вестник . 85 : 104–107. DOI : 10.2307 / 3620485 .

- Дженсен, Андерс Кристиан (2007). «Регрессия Деминга, пакет MethComp» (PDF) .

- Купманс, TC (1937). Линейный регрессионный анализ экономических временных рядов . ДеЭрвен Ф. Бон, Харлем, Нидерланды.

- Kummell, CH (1879). «Редукция уравнений наблюдения, которые содержат более одной наблюдаемой величины». Аналитик . Анналы математики. 6 (4): 97–105. DOI : 10.2307 / 2635646 . JSTOR 2635646 .

- Линнет, К. (1993). «Оценка регрессионных процедур для сравнительных исследований методов» . Клиническая химия . 39 (3): 424–432. PMID 8448852 .

- Минда, Д .; Фелпс, С. (2008). «Треугольники, эллипсы и кубические многочлены» (PDF) . Американский математический ежемесячник . 115 (8): 679–689. Руководство по ремонту 2456092 .[ постоянная мертвая ссылка ]