Корреляция

В статистике корреляция или зависимость — это любая статистическая связь, будь то причинная или нет, между двумя случайными величинами или двумерными данными . Хотя в самом широком смысле «корреляция» может обозначать любой тип ассоциации, в статистике она обычно относится к степени, в которой пара переменных связана линейно . Знакомые примеры зависимых явлений включают корреляцию между ростом родителей и их потомков, а также корреляцию между ценой товара и количеством, которое потребители готовы купить, как это изображено на так называемой кривой спроса .

Корреляции полезны, потому что они могут указывать на прогностическую взаимосвязь, которую можно использовать на практике. Например, электроэнергетическая компания может производить меньше электроэнергии в пасмурный день на основе корреляции между спросом на электроэнергию и погодой. В этом примере существует причинно-следственная связь , поскольку экстремальные погодные условия заставляют людей использовать больше электроэнергии для обогрева или охлаждения. Однако, как правило, наличия корреляции недостаточно, чтобы сделать вывод о наличии причинно-следственной связи (т . е. корреляция не подразумевает причинно -следственную связь ).

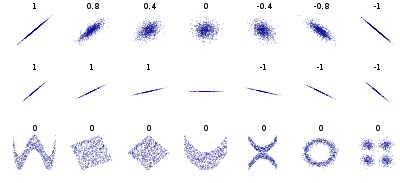

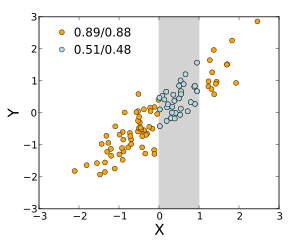

Формально случайные величины являются зависимыми , если они не удовлетворяют математическому свойству вероятностной независимости . Говоря неформальным языком, корреляция является синонимом зависимости . Однако при использовании в техническом смысле корреляция относится к любому из нескольких конкретных типов математических операций между тестируемыми переменными и их соответствующими ожидаемыми значениями . По сути, корреляция — это мера того, как две или более переменных связаны друг с другом. Существует несколько коэффициентов корреляции , часто обозначаемых или , измеряющих степень корреляции. Наиболее распространенным из них является коэффициент корреляции Пирсона ., который чувствителен только к линейной зависимости между двумя переменными (которая может присутствовать, даже если одна переменная является нелинейной функцией другой). Другие коэффициенты корреляции, такие как ранговая корреляция Спирмена, были разработаны, чтобы быть более надежными , чем коэффициент Пирсона, то есть более чувствительными к нелинейным отношениям. [1] [2] [3] Взаимная информация также может применяться для измерения зависимости между двумя переменными.

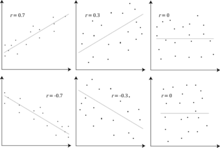

Наиболее известной мерой зависимости между двумя величинами является коэффициент корреляции продукта и момента Пирсона (PPMCC), или «коэффициент корреляции Пирсона», обычно называемый просто «коэффициентом корреляции». Он получается путем взятия отношения ковариации двух рассматриваемых переменных нашего числового набора данных, нормализованного к квадратному корню из их дисперсий. Математически ковариацию двух переменных просто делят на произведение их стандартных отклонений . Карл Пирсон разработал коэффициент на основе похожей, но немного отличающейся идеи Фрэнсиса Гальтона . [4]

Коэффициент корреляции продукта и момента Пирсона пытается установить линию наилучшего соответствия через набор данных из двух переменных, по сути, размещая ожидаемые значения, а полученный коэффициент корреляции Пирсона показывает, насколько фактический набор данных отличается от ожидаемых значений. В зависимости от знака нашего коэффициента корреляции Пирсона мы можем получить либо отрицательную, либо положительную корреляцию, если между переменными нашего набора данных существует какая-либо связь.