| Часть серии по |

| Искусственный интеллект |

|---|

Тест Тьюринга , первоначально называется имитация игры на Алана Тьюринга в 1950 году [2] является проверка способности машины к проявляют интеллектуальное поведение , эквивалентное или неотличима от, что у человека. Тьюринг предположил, что человек-оценщик будет оценивать разговоры на естественном языке между человеком и машиной, предназначенные для генерации человеческих ответов. Оценщик должен знать, что один из двух партнеров в разговоре - это машина, и все участники будут отделены друг от друга. Разговор будет ограничен только текстовым каналом, таким как компьютерная клавиатура и экран, поэтому результат не будет зависеть от способности машины преобразовывать слова в речь. [3]Если оценщик не может достоверно отличить машину от человека, говорят, что машина выдержала испытание. Результаты тестирования не зависят от способности машины давать правильные ответы на вопросы , а зависят только от того, насколько точно ее ответы напоминают ответы человека.

Тест был представлен Тьюрингом в его статье 1950 года « Вычислительные машины и интеллект », когда он работал в Манчестерском университете . [4] Он открывается словами: «Я предлагаю рассмотреть вопрос:« Могут ли машины думать? » » Поскольку «мышление» трудно определить, Тьюринг предпочитает «заменить вопрос другим, который тесно с ним связан, и выражается относительно недвусмысленными словами ". [5]Тьюринг описывает новую форму проблемы в терминах игры для трех человек, называемой «имитационной игрой», в которой следователь задает вопросы мужчине и женщине в другой комнате, чтобы определить правильный пол двух игроков. Новый вопрос Тьюринга: «Существуют ли вообразимые цифровые компьютеры, которые преуспели бы в имитационной игре ?» [2] На этот вопрос, по мнению Тьюринга, действительно можно ответить. В оставшейся части статьи он выступал против всех основных возражений против утверждения, что «машины могут думать». [6]

С тех пор, как Тьюринг впервые представил свой тест, он оказался очень влиятельным и широко подвергшимся критике, а также стал важной концепцией в философии искусственного интеллекта . [7] [8] [9] Некоторые из этих критических замечаний, такие как « Китайская комната» Джона Сёрла , сами по себе противоречивы.

История [ править ]

Философский фон [ править ]

Вопрос о том, могут ли машины мыслить, имеет долгую историю, которая прочно укоренилась в различии между дуалистическими и материалистическими взглядами на разум. Рене Декарт прообразует аспекты теста Тьюринга в своем « Рассуждении о методе» 1637 года, когда пишет:

[H] Как много разных автоматов или движущихся машин может быть создано индустрией человека ... Ибо мы можем легко понять, как устроена машина, так что она может произносить слова и даже давать некоторые ответы на действия телесного типа. , что вызывает изменение его органов; например, при прикосновении к определенной части он может спросить, что мы хотим ему сказать; если в другой части он может воскликнуть, что ему больно, и так далее. Но никогда не бывает, чтобы он строил свою речь по-разному, чтобы должным образом отвечать на все, что может быть сказано в его присутствии, как это может сделать даже самый низкий тип людей. [10]

Здесь Декарт отмечает, что автоматы способны реагировать на человеческие взаимодействия, но утверждает, что такие автоматы не могут должным образом реагировать на вещи, сказанные в их присутствии, так, как это может делать любой человек. Таким образом, Декарт предвосхищает тест Тьюринга, определяя недостаточность соответствующей лингвистической реакции как то, что отделяет человека от автомата. Декарт не учитывает возможность того, что будущие автоматы смогут преодолеть такую недостаточность, и поэтому не предлагает тест Тьюринга как таковой, даже если он заранее представляет его концептуальную основу и критерий.

Дени Дидро формулирует в своих философских трудах Pensées критерий теста Тьюринга:

«Если они найдут попугая, который сможет ответить на все, я без колебаний назову его разумным существом». [11]

Это не значит, что он согласен с этим, но это уже было обычным аргументом материалистов в то время.

В соответствии с дуализмом, то разум является нефизической (или, по крайней мере, имеет не-физические свойства ) [12] , и, следовательно, не могут быть объяснены в чисто физических терминах. Согласно материализму, разум можно объяснить физически, что оставляет возможность искусственно созданных умов. [13]

В 1936 году философ Альфред Айер рассмотрел стандартный философский вопрос других умов : как мы узнаем, что у других людей такой же сознательный опыт, что и у нас? В своей книге « Язык, истина и логика» Айер предложил протокол, позволяющий различать сознательного человека и бессознательную машину: «Единственное основание, которое я могу иметь для утверждения, что объект, который кажется сознательным, на самом деле не является сознательным существом, но только манекен или машина, это то, что они не удовлетворяют одному из эмпирических тестов, с помощью которых определяется наличие или отсутствие сознания ». [14] (Это предположение очень похоже на тест Тьюринга, но касается скорее сознания, чем интеллекта. Более того, нет уверенности, что популярная философская классика Эйера была знакома Тьюрингу.) Другими словами, вещь не осознается, если она не проходит проверку. тест сознания.

Алан Тьюринг [ править ]

Исследователи в Соединенном Королевстве изучали «машинный интеллект» в течение десяти лет до основания области исследований искусственного интеллекта ( ИИ ) в 1956 году. [15] Это была общая тема среди членов Ratio Club , неформальная группа британских исследователей кибернетики и электроники, в которую входил Алан Тьюринг. [16]

Тьюринг, в частности, занимался понятием машинного интеллекта по крайней мере с 1941 года [17], и одно из самых первых известных упоминаний о «компьютерном интеллекте» было сделано им в 1947 году. [18] В отчете Тьюринга «Интеллектуальные машины» », [19] он исследовал« вопрос о том, могут ли машины демонстрировать разумное поведение » [20], и в рамках этого исследования предложил то, что можно считать предвестником его более поздних тестов:

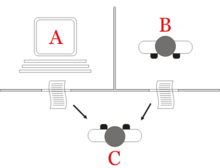

Нетрудно изобрести бумагоделательную машину, которая будет играть в неплохую шахматную партию. [21] Теперь возьмите троих мужчин в качестве испытуемых для эксперимента. A, B и C. A и C должны быть довольно плохими шахматистами, B - оператор, который работает на бумагоделательной машине. ... Две комнаты используются с некоторым расположением для передачи ходов, и игра ведется между C и либо A, либо бумагоделательной машиной. C может быть довольно сложно сказать, что он играет. [22]

« Вычислительные машины и интеллект » ( 1950 ) была первой опубликованной статьей Тьюринга, посвященной исключительно машинному интеллекту. Тьюринг начинается 1950 бумаги с претензией, «Я предлагаю рассмотреть вопрос„Могут ли машина думать? “ » [5] , как он подчеркивает, традиционный подход к такому вопросу, чтобы начать с определениями , определяя как термины «машину» и «интеллект». Тьюринг предпочитает не делать этого; вместо этого он заменяет вопрос новым, «который тесно связан с ним и выражается относительно недвусмысленно». [5] По сути, он предлагает изменить вопрос с «Могут ли машины думать?» к "Могут ли машины делать то, что мы (как мыслящие сущности) можем? "[23] Преимущество нового вопроса, утверждает Тьюринг, состоит в том, что он проводит «довольно резкую грань между физическими и интеллектуальными способностями человека». [24]

Чтобы продемонстрировать этот подход, Тьюринг предлагает тест, вдохновленный партийной игрой , известной как «игра в имитацию», в которой мужчина и женщина входят в разные комнаты, а гости пытаются разделить их, написав серию вопросов и прочитав машинописный текст. ответы отправлены обратно. В этой игре мужчина и женщина стремятся убедить гостей в том, что они другие. (Хума Шах утверждает, что эта версия игры с двумя людьми была представлена Тьюрингом только для того, чтобы познакомить читателя с тестом вопрос-ответ между машиной и человеком. [25] ) Тьюринг описал свою новую версию игры следующим образом:

Теперь мы задаемся вопросом: «Что произойдет, когда машина возьмет на себя роль А в этой игре?» Будет ли допрашивающий принимать неправильные решения так же часто, когда игра ведется подобным образом, как когда он делает, когда игра ведется между мужчиной и женщиной? Эти вопросы заменяют наш исходный вопрос: «Могут ли машины думать?» [24]

Позже в статье Тьюринг предлагает «эквивалентную» альтернативную формулировку, в которой судья разговаривает только с компьютером и человеком. [26] Хотя ни одна из этих формулировок не соответствует более широко известной сегодня версии теста Тьюринга, в 1952 году он предложил третью. В этой версии, которую Тьюринг обсуждал в радиопередаче BBC , жюри задает вопросы компьютеру. а роль компьютера - заставить значительную часть жюри поверить в то, что это действительно человек. [27]

В статье Тьюринга было рассмотрено девять предполагаемых возражений, которые включают в себя все основные аргументы против искусственного интеллекта , выдвинутые за годы, прошедшие после публикации статьи (см. « Вычислительные машины и интеллект »). [6]

ЭЛИЗА и ПАРРИ [ править ]

В 1966 году Джозеф Вайценбаум создал программу, которая, казалось, прошла тест Тьюринга. Программа, известная как ELIZA , работала, исследуя введенные пользователем комментарии по ключевым словам. Если ключевое слово найдено, применяется правило, преобразующее комментарии пользователя, и возвращается итоговое предложение. Если ключевое слово не найдено, ELIZA отвечает либо общим ответом, либо повторением одного из предыдущих комментариев. [28] Кроме того, Вейценбаум разработал ELIZA, чтобы воспроизвести поведение психотерапевта Роджера , что позволило ELIZA «свободно принимать позу, почти ничего не зная о реальном мире». [29]С помощью этих методов программа Вайценбаума смогла обмануть некоторых людей, заставив поверить в то, что они разговаривают с реальным человеком, причем некоторых субъектов «очень трудно убедить в том, что ЭЛИЗА [...] не человек». [29] Таким образом, некоторые утверждают, что ELIZA является одной из программ (возможно, первой), способной пройти тест Тьюринга, [29] [30], хотя эта точка зрения весьма спорна (см. Ниже ).

Кеннет Колби создал PARRY в 1972 году, программу, описанную как «ELIZA с отношением». [31] Он попытался смоделировать поведение параноидального шизофреника , используя подход, аналогичный (хотя и более продвинутому) подходу, который использовал Вайценбаум. Чтобы подтвердить работу, в начале 1970-х годов PARRY был протестирован с использованием варианта теста Тьюринга. Группа опытных психиатров проанализировала комбинацию реальных пациентов и компьютеров, запускающих PARRY через телетайпы . Другой группе из 33 психиатров были показаны стенограммы разговоров. Затем обеим группам было предложено определить, какие из «пациентов» были людьми, а какие - компьютерными программами. [32]Психиатрам удавалось правильно опознать только в 48% случаев - цифра, соответствующая случайным предположениям. [33]

В 21 веке версии этих программ (теперь известные как « чат-боты ») продолжают дурачить людей. Вредоносная программа CyberLover охотится на пользователей Интернета, убеждая их «раскрыть информацию об их личности или побудить их посетить веб-сайт, который доставит вредоносный контент на их компьютеры». [34] Программа превратилась в флирт с «валентинским риском» с людьми, «ищущими отношения в Интернете для сбора своих личных данных». [35]

Китайская комната [ править ]

В статье Джона Сирла 1980 года « Умы, мозги и программы» был предложен мысленный эксперимент « Китайская комната » и утверждалось, что тест Тьюринга нельзя использовать для определения способности машины мыслить. Сирл заметил, что программное обеспечение (такое как ELIZA) могло пройти тест Тьюринга, просто манипулируя символами, которые они не понимали. Без понимания их нельзя назвать «мыслящими» в том же смысле, что и люди. Следовательно, заключает Сирл, тест Тьюринга не может доказать, что машина может мыслить. [36] Как и сам тест Тьюринга, аргумент Сирла был широко раскритикован [37] и поддержан. [38]

Аргументы, подобные аргументам Сирла и других исследователей философии разума, вызвали более интенсивные дебаты о природе интеллекта, возможности создания интеллектуальных машин и ценности теста Тьюринга, которые продолжались в течение 1980-х и 1990-х годов. [39]

Приз Лебнера [ править ]

Премия Лебнера обеспечивает ежегодную платформу для практических тестов Тьюринга, первое соревнование проводится в ноябре 1991 года. [40] Ее подписывает Хью Лебнер . Кембриджский центр поведенческих исследований в Массачусетсе , США, организовал призы до конкурса 2003 года включительно. Как описал Лебнер, одна из причин, по которой был создан конкурс, состоит в том, чтобы улучшить состояние исследований ИИ, по крайней мере частично, потому что никто не предпринял шагов по внедрению теста Тьюринга, несмотря на 40 лет его обсуждения. [41]

Первое соревнование на премию Лебнера в 1991 году привело к возобновлению дискуссии о жизнеспособности теста Тьюринга и ценности его проведения как в популярной прессе [42], так и в академических кругах. [43] Первое состязание было выиграно бездумной программой без опознаваемого интеллекта, которой удалось обмануть наивных следователей, заставив их сделать неправильную идентификацию. Это высветило несколько недостатков теста Тьюринга (обсуждаемых ниже ): победитель выигрывал, по крайней мере частично, потому что он был способен «имитировать человеческие опечатки»; [42] бесхитростных следователей легко обмануть; [43] и некоторые исследователи в области искусственного интеллекта пришли к выводу, что этот тест просто отвлекает от более плодотворных исследований. [44]

Серебряный (только текст) и золотой (аудио и визуальный) призы никогда не разыгрывались. Тем не менее, конкурс ежегодно присуждает бронзовую медаль компьютерной системе, которая, по мнению судей, демонстрирует «наиболее человечное» поведение в разговоре среди работ этого года. Искусственный лингвистический Интернет-компьютерный объект (ALICE) за последнее время трижды выигрывал бронзовую награду (2000, 2001, 2004). Learning AI Jabberwacky выигрывал в 2005 и 2006 годах.

Премия Лебнера проверяет разговорный интеллект; победителями обычно становятся программы чаттер-ботов или искусственные разговорные сущности (ACE) . Ранняя премия Лебнера предписывала ограниченные разговоры: каждая запись и скрытый человек разговаривали на одну тему, [45] таким образом, следователи были ограничены одной линией допроса для каждого взаимодействия сущностей. Правило ограниченного разговора было снято в связи с премией Лебнера 1995 года. В Премии Лебнера продолжительность взаимодействия между судьей и организацией была разной. В Loebner 2003 в Университете Суррея каждому следователю было предоставлено пять минут для взаимодействия с сущностью, машиной или скрытым человеком. В период с 2004 по 2007 годы время взаимодействия, разрешенное в рамках призов Лебнера, составляло более двадцати минут.

Версии [ править ]

Сол Трейджер утверждает, что существует по крайней мере три основных версии теста Тьюринга, две из которых предлагаются в «Вычислительных машинах и интеллекте», а одна, которую он описывает как «Стандартная интерпретация». [46] Хотя есть некоторые споры относительно того, является ли «стандартная интерпретация» той, которая описана Тьюрингом, или, вместо этого, на основе неправильного прочтения его статьи, эти три версии не считаются эквивалентными, [46] и их сильные и слабые стороны отчетливый. [47]

Хума Шах указывает, что сам Тьюринг интересовался, может ли машина мыслить, и предлагал простой метод для проверки этого: через сеансы вопросов и ответов человек-машина. [48] Шах утверждает, что существует одна имитационная игра, которую описал Тьюринг, может быть реализована двумя разными способами: а) индивидуальный тест «дознаватель-машина» и б) одновременное сравнение машины с человеком, причем оба вопроса параллельно подвергаются сомнению. следователь. [25] Так как тест Тьюринга - это тест на неразличимость производительности, вербальная версия естественным образом обобщается на все человеческие способности, как вербальные, так и невербальные (роботизированные). [49]

Имитационная игра [ править ]

В оригинальной статье Тьюринга описана простая партийная игра с участием трех игроков. Игрок A - мужчина, игрок B - женщина, а игрок C (который играет роль дознавателя) - любого пола. В имитационной игре игрок C не может видеть ни игрока A, ни игрока B и может общаться с ними только посредством письменных заметок. Задавая вопросы игроку A и игроку B, игрок C пытается определить, кто из двоих - мужчина, а кто - женщина. Роль игрока А состоит в том, чтобы обманом заставить дознавателя принять неправильное решение, в то время как игрок Б пытается помочь дознавателю принять правильное решение. [7]

Затем Тьюринг спрашивает:

Что произойдет, когда машина возьмет на себя роль А в этой игре? Будет ли допрашивающий принимать неправильные решения так же часто, когда игра ведется подобным образом, как когда он делает, когда игра ведется между мужчиной и женщиной? Эти вопросы заменяют наш исходный вопрос: «Могут ли машины думать?» [24]

Вторая версия появилась позже в статье Тьюринга 1950 года. Как и в оригинальном тесте с имитацией игры, роль игрока А выполняет компьютер. Однако роль игрока B исполняет мужчина, а не женщина.

Давайте сосредоточим наше внимание на одном конкретном цифровом компьютере C. Верно ли, что, изменив этот компьютер, чтобы он имел адекватное хранилище, соответствующим образом увеличив его скорость работы и снабдив его соответствующей программой, можно заставить C удовлетворительно играть роль из A в игре с имитацией, где роль B занимает мужчина? [24]

В этой версии и игрок A (компьютер), и игрок B пытаются обманом заставить дознавателя принять неверное решение.

Стандартная интерпретация [ править ]

Согласно общепринятому мнению, цель теста Тьюринга не в том, чтобы конкретно определить, способен ли компьютер обмануть следователя, заставив его поверить в то, что это человек, а скорее в том, может ли компьютер имитировать человека. [7] Хотя есть некоторые споры о том, была ли эта интерпретация задумана Тьюрингом, Стерретт считает, что это было [50], и, таким образом, объединяет вторую версию с этой, в то время как другие, такие как Трейгер, не делают [46] - тем не менее привело к тому, что можно рассматривать как «стандартную интерпретацию». В этой версии игрок A - компьютер, а игрок B - человек любого пола. Роль дознавателя состоит не в том, чтобы определить, кто из мужчин, а кто из женщин, а в том, чтобы определить, кто из них - компьютер, а кто - человек.[51] Фундаментальная проблема стандартной интерпретации состоит в том, что дознаватель не может различить, какой респондент является человеком, а какой - машиной. Есть вопросы о продолжительности, но стандартная интерпретация обычно считает это ограничение разумным.

Имитационная игра против стандартного теста Тьюринга [ править ]

Споры возникли по поводу того, какую из альтернативных формулировок теста имел в виду Тьюринг. [50] Sterrett утверждает , что две различные тесты могут быть извлечены из его 1950 бумаги и что темпыЗамечание Тьюринга, они не эквивалентны. Тест, который использует групповую игру и сравнивает частоту успеха, называется «тестом оригинальной имитационной игры», тогда как тест, состоящий из человеческого судьи, разговаривающего с человеком и машиной, называется «стандартным тестом Тьюринга». отмечая, что Стерретт отождествляет это со «стандартной интерпретацией», а не со второй версией имитационной игры. Стерретт соглашается с тем, что стандартный тест Тьюринга (STT) имеет проблемы, на которые ссылаются его критики, но считает, что, напротив, исходный тест имитационной игры (OIG-тест), определенный таким образом, невосприимчив ко многим из них из-за принципиального различия: STT, он не делает подобие человеческих качеств критерием, даже несмотря на то, что он использует человеческие возможности при установлении критерия для машинного интеллекта.Мужчина может провалить тест OIG, но утверждают, что это достоинство теста на интеллект, что неудача указывает на недостаток изобретательности: тест OIG требует изобретательности, связанной с интеллектом, а не просто «имитацией разговорного поведения человека». Общая структура теста OIG может быть использована даже с невербальными версиями имитационных игр.[52]

Тем не менее другие авторы [53] интерпретировали Тьюринга как предложение о том, что имитационная игра сама по себе является тестом, не уточняя, как принимать во внимание утверждение Тьюринга о том, что тест, который он предложил с использованием партийной версии имитационной игры, основан на критерии сравнительного анализа. частота успеха в этой имитационной игре, а не способность добиться успеха в одном раунде игры.

Сайгин предположил, что, возможно, оригинальная игра - это способ предложить менее предвзятый экспериментальный дизайн, поскольку он скрывает участие компьютера. [54] Игра в имитацию также включает в себя «социальный взлом», которого нет в стандартной интерпретации, поскольку в игре и компьютер, и мужчина-человек должны играть, притворяясь кем-то, кем они не являются. [55]

Должен ли следователь знать о компьютере? [ редактировать ]

Важнейшей частью любого лабораторного теста является наличие контроля. Тьюринг никогда не проясняет, знает ли следователь в его тестах, что одним из участников является компьютер. Он заявляет только, что игрок A должен быть заменен машиной, а не игрок C должен быть уведомлен об этой замене. [24] Когда Колби, Ф. Д. Хильф, С. Вебер и А. Д. Крамер тестировали PARRY, они сделали это, предположив, что следователям не нужно было знать, что один или несколько из опрашиваемых были компьютером во время допроса. [56] Как подчеркнули Айсе Сайгин, Питер Свирски [57] и другие, это имеет большое значение для реализации и результатов теста. [7] Экспериментальное исследование, посвященноеНарушения принципа Грайсена с использованием стенограммы приза Лебнера «один-к-одному» (собеседник, скрытый от следователя) в соревнованиях по искусственному интеллекту в период 1994–1999 гг. Айсе Сайгин обнаружила существенные различия между ответами участников, которые знали и не знали о задействованных компьютерах. [58]

Сильные стороны [ править ]

Последовательность и простота [ править ]

Сила и привлекательность теста Тьюринга проистекают из его простоты. Философия ума , психологии и современной нейробиологии не смогли дать определения «интеллект» и «мышление», которые достаточно точны и вообще применяться к машинам. Без таких определений невозможно ответить на центральные вопросы философии искусственного интеллекта . Тест Тьюринга, даже если он несовершенен, по крайней мере дает то, что действительно можно измерить. По сути, это прагматическая попытка ответить на сложный философский вопрос.

Широта темы [ править ]

Формат теста позволяет дознавателю ставить перед машиной широкий спектр интеллектуальных задач. Тьюринг писал, что «метод вопросов и ответов кажется подходящим для знакомства практически с любой из областей человеческой деятельности, которую мы хотим включить». [59] Джон Хогеланд добавляет, что «понимания слов недостаточно; вы также должны понимать тему ». [60]

Чтобы пройти хорошо разработанный тест Тьюринга, машина должна использовать естественный язык , рассуждать , обладать знаниями и учиться . Тест может быть расширен за счет включения видеовхода, а также «люка», через который можно пропускать объекты: это заставит машину продемонстрировать умелое использование хорошо продуманного зрения и робототехники . Вместе они представляют собой почти все основные проблемы, которые исследования искусственного интеллекта хотели бы решить. [61]

Тест Фейгенбаума предназначен для использования широкого спектра тем, доступных для теста Тьюринга. Это ограниченная форма игры вопрос-ответ Тьюринга, в которой машина сравнивается со способностями экспертов в определенных областях, таких как литература или химия . IBM «s Уотсон машина достигла успеха в человек против машины телевизионной викторины человеческого знания, Jeopardy! [62] [48] [имеет отношение к этому параграфу? ]

Упор на эмоциональный и эстетический интеллект [ править ]

Будучи выпускником Кембриджа с отличием по математике, можно было ожидать, что Тьюринг предложит тест на компьютерный интеллект, требующий экспертных знаний в какой-то высокотехнологичной области, и, таким образом, предвосхищая более свежий подход к этому предмету . Вместо этого, как уже отмечалось, тест, который он описал в своей основополагающей статье 1950 года, требует, чтобы компьютер был в состоянии успешно участвовать в обычной партийной игре, и для этого он должен действовать так же хорошо, как обычный человек, отвечая на серию вопросов, чтобы убедительно притвориться участницей конкурса.

Учитывая статус человеческого полового диморфизма как одного из самых древних предметов , в приведенном выше сценарии подразумевается, что вопросы, на которые необходимо ответить, не будут включать ни специальные фактические знания, ни методы обработки информации. Задача компьютера, скорее, будет заключаться в том, чтобы продемонстрировать сочувствие к роли женщины, а также продемонстрировать характерную эстетическую чувствительность - оба качества демонстрируются в этом фрагменте диалога, который вообразил Тьюринг:

- Допрашивающий: Скажите, пожалуйста, Х, длину его или ее волос?

- Участник: Мои волосы покрыты черепицей, а самые длинные пряди имеют длину около девяти дюймов.

Когда Тьюринг вводит некоторые специальные знания в один из своих воображаемых диалогов, речь идет не о математике или электронике, а о поэзии:

- Допрашивающий: В первой строке вашего сонета, которая гласит: «Могу ли я сравнить тебя с летним днем», не подойдет ли «весенний день» так же или лучше?

- Свидетель: Он не сканировал .

- Допрашивающий: Как насчет «зимнего дня». Это хорошо просканирует.

- Свидетель: Да, но никто не хочет, чтобы его сравнивали с зимним днем.

Таким образом, Тьюринг еще раз демонстрирует свой интерес к сочувствию и эстетической чувствительности как компонентам искусственного интеллекта; и в свете растущего осознания угрозы, исходящей от безумного ИИ, [63] было высказано предположение [64], что этот фокус, возможно, представляет собой критическую интуицию со стороны Тьюринга, то есть эмоциональный и эстетический интеллект будет играть ключевую роль. в создании « дружественного ИИ ». Далее, однако, отмечается, что любое вдохновение, которое Тьюринг мог бы дать в этом направлении, зависит от сохранения его первоначального видения, то есть, далее, обнародования «стандартной интерпретации» теста Тьюринга, т. Е. , тот, который фокусируется только на дискурсивном интеллекте, должен рассматриваться с некоторой осторожностью.

Слабые стороны [ править ]

Тьюринг прямо не заявил, что тест Тьюринга можно использовать в качестве меры интеллекта или каких-либо других человеческих качеств. Он хотел предоставить ясную и понятную альтернативу слову «думать», которую он затем мог бы использовать, чтобы ответить на критику возможности «думающих машин» и предложить пути дальнейшего развития исследований.

Тем не менее, тест Тьюринга был предложен как мера «способности мыслить» или «интеллекта» машины. Это предложение подверглось критике как со стороны философов, так и со стороны компьютерных ученых. Предполагается, что дознаватель может определить, «думает» ли машина, сравнив ее поведение с поведением человека. Каждый элемент этого предположения подвергался сомнению: надежность суждения дознавателя, ценность сравнения только поведения и ценность сравнения машины с человеком. Из-за этих и других соображений некоторые исследователи искусственного интеллекта сомневаются в релевантности теста для своей области.

Человеческий интеллект против интеллекта в целом [ править ]

Тест Тьюринга напрямую не проверяет, разумно ли ведет себя компьютер. Он проверяет только, ведет ли компьютер себя как человек. Поскольку человеческое поведение и разумное поведение - не одно и то же, тест может не дать точного измерения интеллекта двумя способами:

- Некоторое человеческое поведение неразумно

- Тест Тьюринга требует, чтобы машина могла выполнять все виды человеческого поведения, независимо от того, разумны ли они. Он даже проверяет поведение, которое вообще не может считаться разумным, например, восприимчивость к оскорблениям [65], соблазн солгать или, попросту, высокую частоту опечаток . Если машина не может детально имитировать такое неразумное поведение, она не проходит тест.

- Это возражение было поднято The Economist , в статье под названием « искусственная тупость » , опубликованную вскоре после первого конкурса Loebner премии в 1992 году В статье отмечается , что победа первого победителя Loebner была обусловлена, по крайней мере частично, к его способности «подражать человеческие опечатки ". [42] Сам Тьюринг предлагал программам добавлять ошибки в свои выходные данные, чтобы быть лучшими «игроками» в игре. [66]

- Некоторое разумное поведение бесчеловечно

- Тест Тьюринга не проверяет высокоинтеллектуальное поведение, такое как способность решать сложные проблемы или предлагать оригинальные идеи. В самом деле, в частности , требует обмана со стороны машины: если машина более умный , чем человеческое существо он должен сознательно избегать появления слишком умна. Если бы это было решение вычислительной задачи, которую практически невозможно решить человеку, то следователь знал бы, что программа не человеческая, и машина не прошла бы тест.

- Поскольку он не может измерить интеллект, который находится за пределами возможностей людей, тест не может использоваться для создания или оценки систем, более интеллектуальных, чем люди. Из-за этого было предложено несколько тестовых альтернатив, которые могли бы оценить сверхразумные системы. [67]

Сознание против симуляции сознания [ править ]

Тест Тьюринга касается строго того, как действует субъект - внешнего поведения машины. В этом отношении он использует бихевиористский или функционалистский подход к изучению психики. Пример ELIZA предполагает, что машина, проходящая тест, может имитировать человеческое поведение в разговоре, следуя простому (но обширному) списку механических правил, вообще не думая и не имея ума.

Джон Сирл утверждал, что внешнее поведение не может использоваться для определения того, думает ли машина «на самом деле» или просто «моделирует мышление». [36] Его аргумент в пользу китайской комнаты призван показать, что даже если тест Тьюринга является хорошим рабочим определением интеллекта, он не может указывать на то, что машина обладает разумом , сознанием или интенциональностью . (Интенциональность - это философский термин, обозначающий способность мысли быть «о чем-то».)

Тьюринг предвосхитил эту линию критики в своей оригинальной статье [68], написав:

Я не хочу создавать впечатление, будто считаю, что в сознании нет никакой тайны. Есть, например, парадокс, связанный с любой попыткой его локализовать. Но я не думаю, что эти загадки обязательно нужно разгадывать, прежде чем мы сможем ответить на вопрос, который нас интересует в этой статье. [69]

Наивность следователей и антропоморфная ошибка [ править ]

На практике в результатах теста легко может доминировать не интеллект компьютера, а отношение, навыки или наивность спрашивающего.

Тьюринг не указывает точные навыки и знания, которые требуются следователю в своем описании теста, но он действительно использовал термин «средний следователь»: «[] средний следователь не имел бы более 70% шансов сделать правильный выбор. опознание через пять минут допроса ". [70]

Программы чаттерботов, такие как ELIZA, неоднократно заставляли ничего не подозревающих людей поверить в то, что они общаются с людьми. В этих случаях «следователи» даже не подозревают о возможности взаимодействия с компьютерами. Чтобы успешно выглядеть человеком, машине не обязательно иметь какой-либо разум, требуется лишь внешнее сходство с человеческим поведением.

В соревнованиях на раннюю премию Лебнера использовались «бесхитростные» следователи, которых легко обмануть машины. [43] С 2004 года организаторы премии Лебнера привлекали к допросам философов, компьютерных ученых и журналистов. Тем не менее, некоторые из этих экспертов были обмануты машинами. [71]

Неправильная идентификация человека [ править ]

Одна интересная особенность теста Тьюринга - частота эффекта конфедерации , когда конфедеративные (тестируемые) люди ошибочно идентифицируются следователями как машины. Было высказано предположение, что то, что следователи ожидают от человеческих ответов, не обязательно типично для людей. В результате некоторых людей можно отнести к категории машин. Таким образом, это может работать в пользу конкурирующей машины. Людям приказывают «действовать сами», но иногда их ответы больше похожи на то, что следователь ожидает от машины. [72] Это поднимает вопрос о том, как обеспечить мотивацию людей «действовать по-человечески».

Тишина [ править ]

Важным аспектом теста Тьюринга является то, что машина своими высказываниями должна выдавать себя за машину. Затем дознаватель должен произвести «правильную идентификацию», правильно определив, что машина является именно такой. Однако, если машина молчит во время разговора, то для дознавателя невозможно точно идентифицировать машину, кроме как с помощью расчетного предположения. [73] Даже учет параллельного / скрытого человека как части теста может не помочь в ситуации, поскольку люди часто могут быть ошибочно идентифицированы как машина. [74]

Непрактичность и нерелевантность: тест Тьюринга и исследования ИИ [ править ]

Основные исследователи ИИ утверждают, что попытка пройти тест Тьюринга - это просто отвлечение от более плодотворных исследований. [44] Действительно, тест Тьюринга не является активным объектом многих академических или коммерческих усилий - как пишут Стюарт Рассел и Питер Норвиг : «Исследователи искусственного интеллекта уделяли мало внимания прохождению теста Тьюринга». [75] Тому есть несколько причин.

Во-первых, есть более простые способы протестировать свои программы. Большинство текущих исследований в областях, связанных с ИИ, нацелены на скромные и конкретные цели, такие как автоматическое планирование , распознавание объектов или логистика. Чтобы проверить интеллект программ, которые решают эти проблемы, исследователи искусственного интеллекта просто дают им задачу напрямую. Рассел и Норвиг предлагают провести аналогию с историей полетов : самолеты проверяются по тому, насколько хорошо они летают, а не по сравнению с птицами. « Тексты по авиационной инженерии , - пишут они, - не определяют цель своей области как« создание машин, которые летают так точно, как голуби, что они могут обмануть других голубей » » [75].

Во-вторых, создание реалистичных симуляций людей - сложная задача сама по себе, которую не нужно решать для достижения основных целей исследований ИИ. Правдоподобные человеческие персонажи могут быть интересны в произведении искусства, игре или сложном пользовательском интерфейсе , но они не являются частью науки о создании интеллектуальных машин, то есть машин, которые решают проблемы с помощью интеллекта.

Тьюринг хотел привести ясный и понятный пример, который поможет в обсуждении философии искусственного интеллекта . [76] Джон Маккарти отмечает, что философия ИИ «вряд ли окажет большее влияние на практику исследований ИИ, чем философия науки в целом оказывает на практику науки». [77]

Когнитивная наука [ править ]

Роберт Френч (1990) утверждает, что следователь может различать собеседников-людей и нечеловеческих существ, задавая вопросы, которые раскрывают низкоуровневые (т. Е. Бессознательные) процессы человеческого познания, как это изучается когнитивной наукой . Такие вопросы раскрывают точные детали человеческого воплощения мысли и могут разоблачить компьютер, если он не воспринимает мир так, как это делают люди. [78]

Определение «думать» [ править ]

Алан Тьюринг использовал имитационную игру, чтобы ответить на вопрос: «Может ли машина думать?». Однако, чтобы добиться этого, он изменил вопрос на «Существуют ли вообразимые компьютеры, которые преуспели бы в имитационной игре?» [79] Проблема заключается в том, что подразумевается эквивалентность между тем, что значит «думать», и тем, что это означает «подражать». Эти два действия не синонимичны и не связаны по смыслу. Это ключевой аспект его рациональности в использовании «Игры в имитацию» в качестве теста на интеллект. Без этого изменения тест Тьюринга не отвечает на исходный вопрос.

Варианты [ править ]

Многие другие версии теста Тьюринга, в том числе изложенные выше, были выдвинуты на протяжении многих лет.

Обратный тест Тьюринга и CAPTCHA [ править ]

Модификация теста Тьюринга, в которой цель одной или нескольких ролей поменялась местами между машинами и людьми, называется обратным тестом Тьюринга. Примером подразумевается в работе психоаналитика Уилфред Бион , [80] , который был особенно очарован «шторм» , что в результате столкновения одного ума другим. В своей книге 2000 года [57] среди нескольких других оригинальных замечаний, касающихся теста Тьюринга, литературовед Питер Свирски подробно обсудил идею того, что он назвал тестом Свирски - по сути, обратным тестом Тьюринга. Он отметил, что он преодолевает большинство, если не все стандартные возражения против стандартной версии.

Развивая эту идею, Р. Д. Хиншелвуд [81] описал разум как «аппарат распознавания разума». Задача заключалась в том, чтобы компьютер мог определить, взаимодействует ли он с человеком или другим компьютером. Это расширение исходного вопроса, на который Тьюринг попытался ответить, но, возможно, предложит достаточно высокий стандарт, чтобы определить машину, которая могла бы «думать» способом, который мы обычно определяем как характерно человеческий.

CAPTCHA - это форма обратного теста Тьюринга. Перед тем, как ему будет разрешено выполнить какое-либо действие на веб-сайте, пользователю предлагают буквенно-цифровые символы в искаженном графическом изображении и просят ввести их. Это предназначено для предотвращения использования автоматизированных систем для злоупотребления сайтом. Обоснование состоит в том, что программного обеспечения, достаточно сложного для точного чтения и воспроизведения искаженного изображения, не существует (или недоступно для обычного пользователя), поэтому любая система, способная сделать это, скорее всего, будет человеком.

Программное обеспечение, которое могло бы реверсировать CAPTCHA с некоторой точностью, анализируя шаблоны в движке генерации, начало разрабатываться вскоре после создания CAPTCHA. [82] В 2013 году исследователи из Vicarious объявили, что они разработали систему для решения задач CAPTCHA от Google , Yahoo! и PayPal до 90% времени. [83] В 2014 году инженеры Google продемонстрировали систему, которая может преодолевать проблемы CAPTCHA с точностью 99,8%. [84] В 2015 году Шуман Гхосемаджумдер , бывший руководитель Google по мошенничеству с кликами , заявил, что существуют киберпреступники.сайты, которые за определенную плату преодолеют вызовы CAPTCHA и позволят использовать различные формы мошенничества. [85]

Тест Тьюринга эксперта в предметной области [ править ]

Другой вариант описывается как тест Тьюринга эксперта в предметной области , в котором реакцию машины невозможно отличить от реакции эксперта в данной области. Это также известно как «тест Фейгенбаума» и было предложено Эдвардом Фейгенбаумом в статье 2003 года. [86]

Общий тест Тьюринга [ править ]

«Total Тьюринг тест» [49] вариация теста Тьюринга, предложенная познавательные ученый Stevan Харнады , [87] добавляет еще два требования к традиционному тесту Тьюринга. Допрашивающий может также проверить способности восприятия субъекта (требующие компьютерного зрения ) и способность субъекта манипулировать объектами (требуя робототехники ). [88]

Электронные медицинские карты [ править ]

Письмо, опубликованное в Сообщениях ACM [89]описывает концепцию создания синтетической популяции пациентов и предлагает вариант теста Тьюринга для оценки разницы между синтетическими и реальными пациентами. В письме говорится: «В контексте EHR, хотя врач-человек может легко отличить искусственно созданных пациентов от реальных живых людей, может ли машина быть наделена интеллектом, чтобы делать такое определение самостоятельно?» и далее в письме говорится: «Прежде чем синтетическая идентификация пациентов станет проблемой общественного здравоохранения, законный рынок ЭУЗ может выиграть от применения техник, подобных тесту Тьюринга, для обеспечения большей надежности данных и диагностической ценности. Таким образом, любые новые методы должны учитывать неоднородность пациентов и вероятно, будет более сложным, чем может оценить тест Аллена для восьмого класса по естественным наукам ".

Минимальный интеллектуальный тест сигнала [ править ]

Крис МакКинстри предложил критерий минимального интеллектуального сигнала как «максимальную абстракцию теста Тьюринга» [90], в котором разрешены только двоичные ответы (истина / ложь или да / нет), чтобы сосредоточиться только на способности мыслить. Он устраняет проблемы текстового чата, такие как предвзятость антропоморфизма , и не требует имитации неразумного человеческого поведения , что позволяет создавать системы, превосходящие человеческий интеллект. Однако каждый вопрос должен быть самостоятельным, что делает его больше похожим на тест на IQ, чем на допрос. Обычно он используется для сбора статистических данных, по которым можно измерить производительность программ искусственного интеллекта. [91]

Приз Хаттера [ править ]

Организаторы премии Hutter Prize считают, что сжатие текста на естественном языке - сложная задача искусственного интеллекта, эквивалентная прохождению теста Тьюринга.

Тест сжатия данных имеет некоторые преимущества перед большинством версий и вариаций теста Тьюринга, в том числе:

- Он дает единственное число, которое можно напрямую использовать для сравнения, какая из двух машин «умнее».

- Не требует, чтобы компьютер лгал судье

Основными недостатками использования сжатия данных в качестве теста являются:

- Таким образом невозможно проверить людей.

- Неизвестно, какой конкретный «балл» по этому тесту - если таковой имеется - эквивалентен прохождению теста Тьюринга человеческого уровня.

Другие тесты, основанные на сжатии или колмогоровской сложности [ править ]

Родственный подход к премии Хаттера, появившийся намного раньше, в конце 1990-х, - это включение проблем сжатия в расширенный тест Тьюринга. [92] или тестами, полностью выведенными из сложности Колмогорова . [93] Другие связанные тесты в этой строке представлены Эрнандес-Оралло и Доу. [94]

Алгоритмический IQ, или сокращенно AIQ, - это попытка преобразовать теоретическую универсальную меру интеллекта Легга и Хаттера (основанную на индуктивном выводе Соломонова ) в работающую практическую проверку машинного интеллекта. [95]

Двумя основными преимуществами некоторых из этих тестов являются их применимость к нечеловеческому разуму и отсутствие требований к тестерам-людям.

Тест Эберта [ править ]

Тест Тьюринга вдохновил на создание теста Эберта, предложенного в 2011 году кинокритиком Роджером Эбертом, который проверяет, обладает ли компьютерный синтезированный голос достаточными навыками с точки зрения интонаций, интонаций, тайминга и т. Д., Чтобы рассмешить людей. [96]

Конференции [ править ]

Коллоквиум Тьюринга [ править ]

В 1990 г. исполнилось сорок лет со дня первой публикации статьи Тьюринга «Вычислительные машины и интеллект», и интерес к тесту возобновился. В этом году произошли два значительных события: первое - коллоквиум Тьюринга, который проводился в Университете Сассекса в апреле, и собрал вместе ученых и исследователей из самых разных дисциплин, чтобы обсудить тест Тьюринга с точки зрения его прошлого и настоящего. , и будущее; второй - формирование ежегодного конкурса на Премию Лебнера .

Блей Уитби перечисляет четыре основных поворотных момента в истории теста Тьюринга - публикация «Вычислительной техники и интеллекта» в 1950 году, объявление Джозефа Вайценбаума о ELIZA в 1966 году, создание Кеннетом Колби PARRY , которое было впервые описано в 1972 г. и коллоквиум Тьюринга в 1990 г. [97]

Коллоквиум 2005 года по разговорным системам [ править ]

В ноябре 2005 года в Университете Суррея состоялась первая однодневная встреча разработчиков искусственных речевых сущностей [98], на которой присутствовали победители практических тестов Тьюринга на получение премии Лебнера: Робби Гарнер , Ричард Уоллес и Ролло Карпентер . Среди приглашенных докладчиков были Дэвид Хэмилл , Хью Лебнер (спонсор премии Лебнера ) и Хума Шах .

Симпозиум AISB 2008 г. [ править ]

Параллельно с 2008 Loebner премии состоялась в Университете Рединга , [99] общество по изучению искусственного интеллекта и моделирования поведения (AISB) провели однодневный симпозиум , чтобы обсудить тест Тьюринга, организованный Джоном Barnden , Марк Бишоп , Хума Шах и Кевин Уорвик . [100] Среди выступавших были директор Королевского института баронесса Сьюзан Гринфилд , Селмер Брингсйорд , биограф Тьюринга Эндрю Ходжес и ученый-исследователь сознания Оуэн Холланд.. Согласия по поводу канонического теста Тьюринга достигнуто не было, хотя Брингсьорд выразил мнение, что значительный приз приведет к тому, что тест Тьюринга будет пройден раньше.

Год Алана Тьюринга и Turing100 в 2012 году [ править ]

В течение 2012 года состоялся ряд крупных мероприятий, посвященных жизни Тьюринга и его научному влиянию. Группа Turing100 поддержала эти мероприятия, а также организовала специальное мероприятие по тестированию Тьюринга в Блетчли-парке 23 июня 2012 года, чтобы отпраздновать 100-летие со дня рождения Тьюринга.

См. Также [ править ]

- Обработка естественного языка

- Искусственный интеллект в художественной литературе

- Слепое зрение

- Причинно-следственная связь

- Компьютерный игровой бот Turing Test

- Detroit: Become Human (игра, разработанная Quantic Dream)

- Объяснение

- Пояснительный пробел

- Функционализм

- Графический тест Тьюринга

- HAL 9000 (компьютер 2001 года: космическая одиссея )

- Ex Machina (фильм)

- Тяжелая проблема сознания

- Идеологический тест Тьюринга

- Список вещей, названных в честь Алана Тьюринга

- Марк В. Шейни (бот Usenet)

- Проблема разума и тела

- Зеркальный нейрон

- Философский зомби

- Проблема других умов

- Разобрать механизм с целью понять, как это работает

- Разумность

- Смоделированная реальность

- Технологическая особенность

- Теория разума

- Жуткая долина

- Машина Войта-Кампфа (фиктивный тест Тьюринга от Blade Runner )

- Мир Дикого Запада (сериал)

- Вызов схемы Винограда

- ШРДЛУ

Заметки [ править ]

- ↑ Изображение адаптировано из Сайгина 2000 г.

- ^ a b ( Turing 1950 , p. 442) Тьюринг не называет свою идею «тестом Тьюринга», а скорее «игрой в имитацию»; однако более поздняя литература зарезервировала термин «имитационная игра» для описания конкретной версии теста. См. # Версии теста Тьюринга ниже. Тьюринг дает более точную версию вопроса позже в статье: «Эти вопросы [эквивалентны] следующему:« Давайте сосредоточим наше внимание на одном конкретном цифровом компьютере C. адекватное хранилище, соответствующим образом увеличивающее скорость его действия и обеспечивающее его соответствующей программой, можно заставить C удовлетворительно играть роль A в имитационной игре, причем роль B занимает человек? '"(Тьюринг 1950 , стр. 442)

- ^ Тьюринга первоначально предложил телетайп , один из немногих текстовых только систем связидоступных в 1950 году ( Turing 1950 , стр. 433)

- ^ «Тест Тьюринга, 1950» . turing.org.uk . Интернет-альбом Алана Тьюринга.

- ^ а б в Тьюринг 1950 , стр. 433.

- ^ a b Turing 1950 , pp. 442–454 и см. Russell & Norvig (2003 , p. 948) , где они комментируют: «Тьюринг исследовал широкий спектр возможных возражений против возможности создания интеллектуальных машин, включая практически все те, которые выросли за полвека с момента появления его статьи ".

- ^ Б с д е е Saygın 2000 .

- ^ Russell & Норвиг 2003 , стр. 2-3, 948.

- ^ Swiechowski, Мацей (2020), "Игра AI Конкурсы: Мотивация для имитации игры-Playing конкуренции" (PDF) , Труды 15 - й конференции по информационным системам вычислительной техники и (FedCSIS 2020) , IEEE Издательство: 155-160 , извлекаться 8 сентября 2020 .

- ^ Декарт 1996 , стр. 34 -35.

- Перейти ↑ Diderot 2007 , p. 68.

- ^ Пример дуализма свойств см. В Qualia .

- ^ Отмечая, что материализм не требует возможности искусственного разума (например, Роджер Пенроуз ),точно так же, как дуализм обязательно исключает возможность. (См., Например, дуализм свойств .)

- ^ Айер, А. J. (2001), "Язык, истина и логика", Природа , Пингвин , 138 (3498): 140, Bibcode : 1936Natur.138..823G , DOI : 10.1038 / 138823a0 , ISBN 978-0-334-04122-1, S2CID 4121089[ требуется разъяснение ]

- ^ В Дартмут конференции 1956 года широко считается «рождение ИИ». ( Crevier 1993 , стр. 49)

- ^ McCorduck 2004 , стр. 95.

- Перейти ↑ Copeland 2003 , p. 1.

- Перейти ↑ Copeland 2003 , p. 2.

- ^ "Интеллектуальные машины" (1948) не были опубликованы Тьюрингом и не публиковались до 1968 года в:

- Эванс, ADJ; Робертсон (1968), Кибернетика: ключевые статьи , University Park Press

- ^ Тьюринг 1948 , стр. 412.

- ↑ В 1948 году, работая со своим бывшим коллегой по бакалавриату Д.Г. Чамперноуном , Тьюринг начал писать шахматную программу для компьютера, которого еще не было, и в 1952 году, не имея компьютера, достаточно мощного для выполнения этой программы, сыграл в игру, в которой моделировал это занимает около получаса на каждое движение. Игра была записана, и программа проиграла коллеге Тьюринга Алику Гленни , хотя, как говорят, она выиграла игру у жены Чамперноуна.

- ^ Тьюринг 1948 , стр. [ необходима страница ] .

- ^ Харнад 2004 , стр. 1.

- ^ a b c d e Тьюринг 1950 , стр. 434.

- ^ a b Shah & Warwick 2010a .

- ^ Тьюринг 1950 , стр. 446.

- ↑ Тьюринг, 1952 , стр. 524–525. Тьюринг, кажется, не делает различия между «мужчиной» как полом и «мужчиной» как человеком. В первом случае эта формулировка была бы ближе к игре в имитацию, тогда как во втором она была бы ближе к текущим описаниям теста.

- ^ Weizenbaum 1966 , стр. 37.

- ^ a b c Вайценбаум 1966 , стр. 42.

- Перейти ↑ Thomas 1995 , p. 112.

- Перейти ↑ Bowden 2006 , p. 370.

- ^ Колби и др. 1972 , стр. 42.

- ^ Сайгин 2000 , стр. 501.

- ↑ Withers, Стивен (11 декабря 2007 г.), «Flirty Bot Passes for Human» , iTWire

- ↑ Уильямс, Ян (10 декабря 2007 г.), «Интернет-любители любви предупредили ботов-флиртов» , V3

- ^ а б Сирл 1980 .

- ^ Существует множество аргументов против китайской комнаты Серла. Некоторые из них:

- Hauser, Ларри (1997), "Серла китайский Box: Развенчание аргумент китайской комнаты", Minds и машины , 7 (2): 199-226, DOI : 10,1023 / A: 1008255830248 , S2CID 32153206.

- Рехман, Уоррен. (19 июля 2009 г.), Аргумент против аргумента о китайской комнате , заархивировано из оригинала 19 июля 2010 г..

- Thornley, Дэвид Х. (1997), Почему китайский номер не работает , архивируются с оригинала на 26 апреля 2009

- ^ М. Бишоп и Дж. Престон (ред.) (2001) Очерки аргументации Сирла о китайской комнате. Издательство Оксфордского университета.

- ^ Сайгин 2000 , стр. 479.

- ^ Сундман 2003 .

- ^ Loebner 1994 .

- ^ a b c «Искусственная глупость». Экономист . Vol. 324 нет. 7770. 1 августа 1992 г., с. 14.

- ^ a b c Шапиро 1992 , стр. 10–11 и Shieber 1994 , среди прочих.

- ^ а б Шибер 1994 , стр. 77.

- ^ «Тест Тьюринга, сезон 4, эпизод 3» . Scientific American Frontiers . Компания Chedd-Angier Production. 1993–1994 гг. PBS . Архивировано 2006 годом.

- ^ а б в Трейгер 2000 .

- ^ Saygın, Roberts & Beber 2008 .

- ^ а б Шах 2011 .

- ^ a b Оппи, Грэм и Доу, Дэвид (2011) Тест Тьюринга . Стэнфордская энциклопедия философии .

- ^ а б Мур 2003 .

- ^ Трейджер 2000 , стр. 99.

- ^ Стерретт 2000 .

- ↑ Genova, 1994 , Hayes & Ford, 1995 , Heil, 1998 , Dreyfus, 1979.

- ^ Р. Эпштейн, Г. Робертс, Г. Поланд, (ред.) Анализ теста Тьюринга: философские и методологические вопросы в поисках мыслящего компьютера. Springer: Дордрехт, Нидерланды

- ↑ Томпсон, Клайв (июль 2005 г.). «Другой тест Тьюринга» . Выпуск 13.07 . Журнал WIRED . Проверено 10 сентября 2011 года .

Как гей, который провел почти всю свою жизнь в туалете, Тьюринг, должно быть, хорошо осознавал социальную сложность постоянного подделки своей настоящей личности.

И есть восхитительная ирония в том, что десятилетиями ученые ИИ предпочитали игнорировать тест Тьюринга на изменение пола - только для того, чтобы за него ухватились три женщины студенческого возраста.

. ( Полная версия ). - ^ Колби и др. 1972 .

- ^ а б Свирски 2000 .

- ^ Saygın & Cicekli 2002 .

- ^ Тьюринг 1950 , в разделе «Критика новой проблемы».

- ^ Haugeland 1985 , стр. 8.

- ^ «Эти шесть дисциплин, - пишут Стюарт Дж. Рассел и Питер Норвиг , - представляют большую часть ИИ». Рассел и Норвиг 2003 , стр. 3

- ^ "Ватсон побеждает 'Jeopardy!' IBM Challenge» , Sony Pictures , 16 февраля 2011, в архиве с оригинала на 22 мая 2011

- ^ Урбан, Тим (февраль 2015). «Революция искусственного интеллекта: наше бессмертие или исчезновение» . Подождите, но почему . Проверено 5 апреля 2015 года .

- ^ Смит, GW (27 марта 2015 г.). «Искусство и искусственный интеллект» . ArtEnt. Архивировано 25 июня 2017 года . Проверено 27 марта 2015 года .

- ^ Saygın & Cicekli 2002 , стр. 227-258.

- ^ Тьюринг 1950 , стр. 448.

- ^ Несколько альтернатив тесту Тьюринга, предназначенному для оценки машин более умных, чем люди:

- Хосе Эрнандес-Orallo (2000), "За Тест Тьюринга", журнал логика, язык и информации , 9 (4): 447-466, CiteSeerX 10.1.1.44.8943 , DOI : 10.1023 / A: 1008367325700 , S2CID 14481982 .

- DL Dowe & AR Hajek (1997), «Вычислительное расширение теста Тьюринга» , Труды 4-й конференции Австралазийского общества когнитивных наук , заархивировано из оригинала 28 июня 2011 года , извлечено 21 июля 2009 года .

- Шейн Легг и Маркус Хаттер (2007), «Универсальный интеллект: определение машинного интеллекта» (PDF) , Minds and Machines , 17 (4): 391–444, arXiv : 0712.3329 , Bibcode : 2007arXiv0712.3329L , doi : 10.1007 / s11023-007-9079-х , S2CID 847021 , архивируются от исходного (PDF) 18 июня 2009 , получен 21 июля 2009 .

- Эрнандес-Оралло, Дж .; Dowe, DL (2010), "Измерение универсального интеллекта: на пути к Anytime Intelligence Test", Искусственный интеллект , 174 (18): 1508-1539, DOI : 10.1016 / j.artint.2010.09.006 .

- ^ Russell & Norvig (2003 , стр. 958–960)идентифицируют аргумент Сирла с ответом Тьюринга.

- ^ Тьюринг 1950 .

- ^ Тьюринг 1950 , стр. 442.

- ^ Шах и Уорвик 2010j .

- ^ Кевин Уорвик; Хума Шах (июнь 2014 г.). «Ошибочная идентификация человека в тестах Тьюринга». Журнал экспериментального и теоретического искусственного интеллекта . 27 (2): 123–135. DOI : 10.1080 / 0952813X.2014.921734 . S2CID 45773196 .

- ^ Уорвик, Кевин; Шах, Хума (4 марта 2017 г.). «Принимая пятую поправку в имитационной игре Тьюринга» (PDF) . Журнал экспериментального и теоретического искусственного интеллекта . 29 (2): 287–297. DOI : 10.1080 / 0952813X.2015.1132273 . ISSN 0952-813X . S2CID 205634569 .

- ^ Уорвик, Кевин; Шах, Хума (4 марта 2015 г.). «Ошибочная идентификация человека в тестах Тьюринга». Журнал экспериментального и теоретического искусственного интеллекта . 27 (2): 123–135. DOI : 10.1080 / 0952813X.2014.921734 . ISSN 0952-813X . S2CID 45773196 .

- ^ a b Russell & Norvig 2003 , стр. 3.

- ^ Тьюринг 1950 , под заголовком «Игра в имитацию», где он пишет: «Вместо того, чтобы пытаться дать такое определение, я заменю вопрос другим, тесно связанным с ним и выраженным относительно недвусмысленно».

- ^ Маккарти, Джон (1996), «Философия искусственного интеллекта» , Что общего у ИИ с философией?

- ^ Французский, Роберт М. , "Субпознание и пределы теста Тьюринга", Mind , 99 (393): 53–65

- ^ Тьюринг, Алан (октябрь 1950), «Вычислительные машины и интеллект», Mind, LIX (236): 433–460, DOI: 10.1093 / mind / LIX.236.433, ISSN 0026-4423

- Перейти ↑ Bion 1979 .

- ^ Hinshelwood 2001 .

- ^ Малик, Джитендра ; Мори, Грег, Нарушение визуальной капчи

- ^ Пачаль, Пит, Captcha FAIL: исследователи взломали самый популярный тест Тьюринга в Интернете

- ^ Тунг, Лиам, алгоритм Google блокирует CAPTCHA с точностью 99,8%

- ^ Ghosemajumder, Шуман, Подражание игры: Новая линия фронта безопасности

- ^ McCorduck 2004 , стр. 503-505, Фейгенбаум 2003 . Экспертный тест по предмету также упоминается в Kurzweil (2005).

- ^ Гент, Эдд (2014), Тест Тьюринга: многопутевый подход к мозговым вычислениям

- ^ Russell & Норвиг 2010 , стр. 3.

- ^ Cacm Staff (2017). «Скачок от искусственного интеллекта». Коммуникации ACM . 61 : 10–11. DOI : 10.1145 / 3168260 .

- ^ http://tech.groups.yahoo.com/group/arcondev/message/337

- ^ МакКинстри, Крис (1997), «Тест минимального интеллектуального сигнала: альтернативный тест Тьюринга» , Канадский искусственный интеллект (41)

- ^ DL Dowe & AR Hajek (1997), «Вычислительное расширение теста Тьюринга» , Труды 4-й конференции Австралазийского общества когнитивных наук , заархивировано из оригинала 28 июня 2011 года , извлечено 21 июля 2009 года .

- ^ Jose Hernandez-Orallo (2000), "За Тест Тьюринга", журнал логика, язык и информации , 9 (4): 447-466, CiteSeerX 10.1.1.44.8943 , DOI : 10.1023 / A: 1008367325700 , S2CID 14481982 .

- ^ Hernandez-Orallo и Dowe 2010 .

- ^ Аппроксимация универсальной меры интеллекта, Шейн Легг и Джоэл Венесс, 2011 Мемориальная конференция Соломонова

- ^ Alex_Pasternack (18 апреля 2011). «MacBook, возможно, дал Роджеру Эберту его голос, но iPod спас ему жизнь (видео)» . Материнская плата. Архивировано из оригинального 6 -го сентября 2011 года . Проверено 12 сентября 2011 года .

Он называет это «тестом Эберта» в честь стандарта ИИ Тьюринга ...

- Перейти ↑ Whitby 1996 , p. 53.

- ^ ALICE Anniversary и коллоквиум Диалог , ALICE Искусственный интеллект Foundation, архивируются с оригинала на 16 апреля 2009 года , получен 29 марта 2009

- ^ Loebner Prize 2008 , Университет Рединга , извлекаться 29 марта 2009[ постоянная мертвая ссылка ]

- ^ Симпозиум AISB 2008 по тесту Тьюринга , Общество по изучению искусственного интеллекта и моделирования поведения, заархивировано из оригинала 18 марта 2009 г. , извлечено 29 марта 2009 г.

Ссылки [ править ]

- Бион, WS (1979), «Лучшее из плохой работы», Clinical Seminars and Four Papers , Abingdon: Fleetwood Press.

- Боуден, Маргарет А. (2006), Разум как машина: история когнитивной науки , Oxford University Press , ISBN 978-0-19-924144-6

- Колби, км; Hilf, FD; Вебер, С .; Кремер, H. (1972), "Тьюринга как неразличимости тесты для проверки компьютерного моделирования параноидальных процессов", искусственного интеллекта , 3 : 199-221, DOI : 10,1016 / 0004-3702 (72) 90049-5

- Коупленд, Джек (2003), Мур, Джеймс (редактор), «Тест Тьюринга», Тест Тьюринга: неуловимый стандарт искусственного интеллекта , Springer, ISBN 978-1-4020-1205-1

- Кревье, Даниэль (1993), AI: Бурный поиск искусственного интеллекта , Нью-Йорк, Нью-Йорк: BasicBooks, ISBN 978-0-465-02997-6

- Декарт, Рене (1996). Беседа о методе и размышлениях о первой философии . Нью-Хейвен и Лондон: Издательство Йельского университета. ISBN 978-0300067729.

- Дидро, Д. (2007), Pensees Philosophiques, Addition aux Pensees Philosophiques , [Flammarion], ISBN 978-2-0807-1249-3

- Дрейфус, Хуберт (1979), Что компьютеры все еще не могут сделать , Нью-Йорк: MIT Press, ISBN 978-0-06-090613-9

- Фейгенбаум, Эдвард А. (2003), "Некоторые проблемы и грандиозные задачи для вычислительного интеллекта", Журнал ACM , 50 (1): 32-40, DOI : 10,1145 / 602382,602400 , S2CID 15379263

- Французский, Роберт М. (1990), "Subcognition и пределы Теста Тьюринга" , разум , 99 (393): 53-65, DOI : 10,1093 / ум / xcix.393.53 , S2CID 38063853

- Genova, J. (1994), "Тьюринга Половой угадайку", Социальная эпистемология , 8 (4): 314-326, DOI : 10,1080 / 02691729408578758

- Харнад, Стеван (2004), «Игра с аннотациями: о Тьюринге (1950) о вычислениях, машинах и интеллекте», в Эпштейне, Роберт; Питерс, Грейс (ред.), Справочник по тесту Тьюринга: философские и методологические вопросы в поисках мыслящего компьютера , Klewer

- Хогеланд, Джон (1985), Искусственный интеллект: Самая идея , Кембридж, Массачусетс: MIT Press.

- Хейс, Патрик; Форд, Кеннет (1995), «Тест Тьюринга считается вредным», Труды четырнадцатой международной совместной конференции по искусственному интеллекту (IJCAI95-1), Монреаль, Квебек, Канада. : 972–997

- Хайль, Джон (1998), Философия разума: современное введение , Лондон и Нью-Йорк: Routledge, ISBN 978-0-415-13060-8

- Хиншелвуд, Р. Д. (2001), Групповой менталитет и наличие разума: размышления о работе Биона по группам и психозам

- Курцвейл, Рэй (1990), Эпоха интеллектуальных машин , Кембридж, Массачусетс: MIT Press, ISBN 978-0-262-61079-7

- Курцвейл, Рэй (2005), Сингулярность близка , Penguin Books, ISBN 978-0-670-03384-3

- Loebner, Хью Gene (1994), "В ответ" , связь по АКМ , 37 (6): 79-82, DOI : 10,1145 / 175208,175218 , S2CID 38428377 , получен 22 марта +2008

- МакКордак, Памела (2004), Машины, которые думают (2-е изд.), Натик, Массачусетс: AK Peters, Ltd., ISBN 1-56881-205-1

- Мур, Джеймс, изд. (2003), Тест Тьюринга: Неуловимый стандарт искусственного интеллекта , Дордрехт: Kluwer Academic Publishers, ISBN 978-1-4020-1205-1

- Пенроуз, Роджер (1989), Новый разум императора: относительно компьютеров, разума и законов физики , Oxford University Press, ISBN 978-0-14-014534-2

- Рассел, Стюарт ; Норвиг, Питер (2003) [1995]. Искусственный интеллект: современный подход (2-е изд.). Прентис Холл. ISBN 978-0137903955.

- Рассел, Стюарт Дж .; Норвиг, Питер (2010), Искусственный интеллект: современный подход (3-е изд.), Верхняя Сэдл-Ривер, Нью-Джерси: Prentice Hall, ISBN 978-0-13-604259-4

- Сайгин А.П .; Cicekli, I .; Akman, В. (2000), "Тест Тьюринга: 50 лет спустя" (PDF) , Minds и машины , 10 (4): 463-518, DOI : 10,1023 / A: 1011288000451 , ЛВП : 11693/24987 , S2CID 990084. Перепечатано в Moor (2003 , стр. 23–78).

- Сайгин А.П .; Cicekli, I. (2002), "Прагматик в человеке с компьютером разговора", журнал Прагматик , 34 (3): 227-258, CiteSeerX 10.1.1.12.7834 , DOI : 10.1016 / S0378-2166 (02) 80001-7.

- Сайгин А.П .; Робертс, Гэри; Бебер, Грейс (2008), «Комментарии Алана Тьюринга к книге« Вычислительные машины и интеллект »», в Epstein, R .; Робертс, G .; Польша, Г. (ред.), Анализ теста Тьюринга: философские и методологические вопросы в поисках мыслящего компьютера , Дордрехт, Нидерланды: Springer, Bibcode : 2009pttt.book ..... E , doi : 10.1007 / 978- 1-4020-6710-5 , ISBN 978-1-4020-9624-2, S2CID 60070108

- Серла, Джон (1980), "Умы, Мозги и программа" , поведенческие и мозг науки , 3 (3): 417-457, DOI : 10,1017 / S0140525X00005756. Номера страниц выше относятся к стандартному PDF- принту статьи. См. Также оригинальный черновик Сирла .

- Шах, Хума; Уорвик, Кевин (2009a), «Эмоции в тесте Тьюринга: тенденция к снижению машин в недавних призах Лебнера», в Валлверду, Хорди; Дэвид Касакуберта (ред.), Справочник по исследованиям синтетических эмоций и общительной робототехники: новые приложения в эффективных вычислениях и искусственном интеллекте , информатика, IGI, ISBN 978-1-60566-354-8

- Шах, Хума; Warwick, Кевин (апрель 2010a), "пять минут, параллельно паре имитация игры Тестирование Тьюринга", Kybernetes , 4 (3): 449-465, DOI : 10,1108 / 03684921011036178

- Шах, Хума; Warwick, Кевин (2010j июня), "Hidden Собеседница Ошибочное в практических тестах Тьюринга", Умов и машин , 20 (3): 441-454, DOI : 10.1007 / s11023-010-9219-6 , S2CID 34076187

- Шах, Хума (5 апреля 2011 г.), неправильно понятая имитационная игра Тьюринга и успех IBM Watson

- Шапиро, Стюарт С. (1992), "Тест Тьюринга и экономист", ACM SIGART Бюллетень , 3 (4): 10-11, DOI : 10,1145 / 141420,141423 , S2CID 27079507

- Шибер, Стюарт М. (1994), «Уроки ограниченного теста Тьюринга» , Сообщения ACM , 37 (6): 70–78, arXiv : cmp-lg / 9404002 , Bibcode : 1994cmp.lg .... 4002S , CiteSeerX 10.1.1.54.3277 , doi : 10.1145 / 175208.175217 , S2CID 215823854 , получено 25 марта 2008 г.

- Sterrett, С. (2000), "Два Тест Тьюринга интеллекта", разум и машины , 10 (4): 541, DOI : 10,1023 / A: 1011242120015 , ЛВП : 10057/10701 , S2CID 9600264(перепечатано в "Тесте Тьюринга: неуловимый стандарт искусственного интеллекта" под редакцией Джеймса Х. Мура, Kluwer Academic 2003) ISBN 1-4020-1205-5

- Сундман, Джон (26 февраля 2003 г.), «Искусственная глупость» , Salon.com , заархивировано из оригинала 7 марта 2008 г. , извлечено 22 марта 2008 г.

- Томас, Питер Дж. (1995), Социальные и интерактивные аспекты человеко-компьютерных интерфейсов , Cambridge University Press , ISBN 978-0-521-45302-8

- Свирски, Питер (2000), Между литературой и наукой: По, Лем и исследования в области эстетики, когнитивной науки и литературных знаний , издательство McGill-Queen's University Press , ISBN 978-0-7735-2078-3

- Трейджер, Саул (2000), " Как сделать правильный идентификации в тесте Тьюринга", Minds и машины , 10 (4): 561, DOI : 10,1023 / A: 1011254505902 , S2CID 2302024(перепечатано в "Тесте Тьюринга: неуловимый стандарт искусственного интеллекта" под редакцией Джеймса Х. Мура, Kluwer Academic 2003) ISBN 1-4020-1205-5

- Тьюринг, Алан (1948), «Машинный интеллект», в Коупленде, Б. Джек (редактор), The Essential Turing: идеи, которые породили компьютерный век , Oxford: Oxford University Press, ISBN 978-0-19-825080-7

- Тьюринг, Алан (октябрь 1950 г.), «Вычислительные машины и интеллект», Mind , LIX (236): 433–460, DOI : 10.1093 / mind / LIX.236.433 , ISSN 0026-4423

- Тьюринг, Алан (1952), «Можно ли сказать, что автоматические вычислительные машины мыслят?», В Copeland, B. Jack (ed.), The Essential Turing: The Ideas, whichони родили компьютерный век , Oxford: Oxford University Press, ISBN 978-0-19-825080-7

- Weizenbaum, Джозеф (январь 1966), "Элиза - Компьютерная программа для изучения естественного языка коммуникации между человеком и машиной", коммуникаций ACM , 9 (1): 36-45, DOI : 10,1145 / 365153,365168 , S2CID 1896290

- Уитби, Блей (1996), «Тест Тьюринга: самый большой тупик ИИ?» В Милликане, Питер; Кларк, Энди (ред.), Машины и мысль: Наследие Алана Тьюринга , 1 , Oxford University Press , стр. 53–62, ISBN 978-0-19-823876-8

- Зильберберг, А .; Кало, Э. (2007), «Оптимизация лжи в доменах, ориентированных на состояние на основе генетических алгоритмов», Труды VI Иберо-американского симпозиума по разработке программного обеспечения : 11–18, ISBN 978-9972-2885-1-7

Дальнейшее чтение [ править ]

- Коэн, Пол Р. (2006), « " если не Тьюринг тест, тогда что?» , Журнал AI , 26 (4).

- Маркус, Гэри , «Я человек ?: Исследователям нужны новые способы отличить искусственный интеллект от естественного», Scientific American , vol. 316, нет. 3 (март 2017 г.), стр. 58–63. Необходимы многочисленные тесты эффективности искусственного интеллекта, потому что «так же, как не существует единого теста спортивного мастерства, не может быть единого окончательного теста интеллекта».«Один из таких тестов,« Строительный вызов », будет проверять восприятие и физическое действие -« два важных элемента разумного поведения, которые полностью отсутствовали в исходном тесте Тьюринга ». Другое предложение заключалось в том, чтобы дать машинам те же стандартизированные научные тесты и другие дисциплины, которые изучают школьники. Пока что непреодолимым камнем преткновения для искусственного интеллекта является неспособность надежного устранения неоднозначности » . [V] Практически каждое предложение [которое люди создают] неоднозначно , часто во многих отношениях». Яркий пример известен как «проблема разрешения неоднозначности местоимения»: у машины нет способа определить, к кому или к какому местоимению в предложении относится, например, «он», «она» или «оно».

- Мур, Джеймс Х. (2001), "Статус и будущий Тест Тьюринга" , умы и машин , 11 (1): 77-93, DOI : 10,1023 / A: 1011218925467 , ISSN 0924-6495 , S2CID 35233851 .

- Уорвик, Кевин и Шах, Хума (2016), «Имитационная игра Тьюринга: беседы с неизвестным», Cambridge University Press.

Внешние ссылки [ править ]

| Викискладе есть медиафайлы по теме теста Тьюринга . |

- Тест Тьюринга - опера Джулиана Вагстаффа

- Тест Тьюринга на Керли

- Тест Тьюринга - насколько точным может быть тест Тьюринга?

- Залта, Эдвард Н. (ред.). «Тест Тьюринга» . Стэнфордская энциклопедия философии .

- Тест Тьюринга: 50 лет спустя рассматривает полувековую работу над тестом Тьюринга с точки зрения 2000 года.

- Ставка между Капором и Курцвейлом , включая подробное обоснование их соответствующих позиций.

- Почему тест Тьюринга - самый большой тупик ИИ, Блей Уитби

- Jabberwacky.com ИИ Chatterbot , который узнает от и подражает людей

- Очерки New York Times о машинном интеллекте, часть 1 и часть 2

- « » Первый в истории (ограниченный) Turing тест», на 2 сезона, эпизод 5" . Scientific American Frontiers . Компания Chedd-Angier Production. 1991–1992 гг. PBS . Архивировано 2006 годом.

- Информатика. Непрерывная обучающая деятельность для теста Тьюринга.

- Wiki News: «Обсуждение: компьютерные профессионалы отмечают 10-летие ALICE»