В статистике и обработке сигналов , то принцип ортогональности является необходимым и достаточным условием оптимальности оценки байесовской . В общих чертах принцип ортогональности гласит, что вектор ошибок оптимальной оценки (в смысле среднеквадратичной ошибки ) ортогонален любой возможной оценке. Принцип ортогональности чаще всего формулируется для линейных оценок, но возможны и более общие формулировки. Поскольку этот принцип является необходимым и достаточным условием оптимальности, его можно использовать для поиска оценки минимальной среднеквадратичной ошибки .

Принцип ортогональности для линейных оценщиков [ править ]

Принцип ортогональности чаще всего используется при линейной оценке. [1] В этом контексте пусть x будет неизвестным случайным вектором, который должен быть оценен на основе вектора наблюдения y . Хочется построить линейную оценку для некоторой матрицы H и вектора c . Тогда принцип ортогональности гласит, что оценщик достигает минимальной среднеквадратичной ошибки тогда и только тогда, когда

- и

Если x и y имеют нулевое среднее значение, тогда достаточно потребовать первого условия.

Пример [ править ]

Предположим, что x - гауссовская случайная величина со средним m и дисперсией. Также предположим, что мы наблюдаем значение, где w - гауссовский шум, который не зависит от x и имеет среднее значение 0 и дисперсию. Мы хотим найти линейную оценку, минимизирующую MSE. Подставляя выражение в два требования принципа ортогональности, получаем

и

Решение этих двух линейных уравнений для h и c приводит к

так что линейная оценка минимальной среднеквадратичной ошибки определяется выражением

Эту оценку можно интерпретировать как средневзвешенное значение между зашумленными измерениями y и предыдущим ожидаемым значением m . Если дисперсия шума мала по сравнению с дисперсией предшествующего (соответствующего высокому SNR ), то большая часть веса придается измерениям y , которые считаются более надежными, чем априорная информация. И наоборот, если дисперсия шума относительно выше, тогда оценка будет близка к m , поскольку измерения недостаточно надежны, чтобы перевесить априорную информацию.

Наконец, обратите внимание, что, поскольку переменные x и y вместе являются гауссовскими, оценка минимальной MSE является линейной. [2] Следовательно, в этом случае описанная выше оценка минимизирует MSE среди всех оценок, а не только линейных оценок.

Общая формулировка [ править ]

Позвольте быть гильбертовым пространством случайных величин со скалярным продуктом, определенным . Предположим , это замкнутое подпространство , представляющее пространство всех возможных оценок. Хочется найти вектор, который аппроксимирует вектор . Точнее, хотелось бы минимизировать среднеквадратичную ошибку (MSE) между и .

В частном случае линейных оценок, описанных выше, пространство - это набор всех функций от и , а набор линейных оценок, т. Е. Линейных функций только от. Другие параметры, которые могут быть сформулированы таким образом, включают подпространство причинных линейных фильтров и подпространство всех (возможно, нелинейных) оценок.

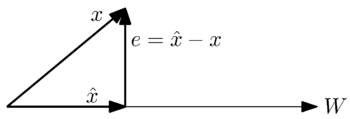

Геометрически мы можем увидеть эту проблему в следующем простом случае, когда - одномерное подпространство:

Мы хотим найти наиболее близкое приближение к вектору вектором в пространстве . Из геометрической интерпретации интуитивно понятно, что наилучшее приближение или наименьшая ошибка возникает, когда вектор ошибки ортогонален векторам в пространстве .

Точнее, общий принцип ортогональности утверждает следующее: для данного замкнутого подпространства оценок в гильбертовом пространстве и элемента в элементе достигается минимальная MSE среди всех элементов в том и только тогда, когда для всех

Сформулированный таким образом, этот принцип является просто формулировкой проекционной теоремы Гильберта . Тем не менее, широкое использование этого результата в обработке сигналов привело к названию «принцип ортогональности».

Решение проблем минимизации ошибок [ править ]

Ниже приводится один из способов найти оценку минимальной среднеквадратичной ошибки с использованием принципа ортогональности.

Мы хотим иметь возможность аппроксимировать вектор с помощью

куда

представляет собой приближение как линейную комбинацию векторов в подпространстве, охватываемом Следовательно, мы хотим иметь возможность найти коэффициенты , чтобы мы могли записать наше приближение в известных терминах.

По теореме ортогональности, квадрат нормы вектора ошибки, , сводится к минимуму , когда для всех J ,

Развивая это уравнение, получаем

Если имеется конечное число векторов , можно записать это уравнение в матричной форме как

Предполагая , являются линейно независимыми , то Определитель Грама можно инвертировать с получением

таким образом обеспечивая выражение для коэффициентов оценки минимальной среднеквадратичной ошибки.

См. Также [ править ]

Заметки [ править ]

- ^ Кей, с.386

- ^ См. Статью Минимальная среднеквадратичная ошибка .

Ссылки [ править ]

- Кей, С.М. (1993). Основы статистической обработки сигналов: теория оценивания . Прентис Холл. ISBN 0-13-042268-1.

- Луна, Тодд К. (2000). Математические методы и алгоритмы обработки сигналов . Прентис-Холл. ISBN 0-201-36186-8.